Cette image d'une frappe de missile sur une base américaine au Qatar a été générée par IA

- Publié le 25 mars 2026 à 16:27

- Lecture : 6 min

- Par : Pierre MOUTOT, AFP France

Les pays du Golfe sont confrontés depuis le début de la guerre au Moyen-Orient à des frappes régulières de missiles et de drones en provenance d'Iran. Elles ciblent les installations énergétiques et les bases américaines présentes sur leur sol, dans une logique d'extension régionale du conflit. Si de très nombreuses vidéos authentiques du conflit circulent, beaucoup d'autres, créées par IA ou venant d'autres conflits, sont aussi massivement partagées sur les réseaux sociaux. Parmi elles, une vidéo censée montrer une frappe sur une base américaine au Qatar. Mais attention: elle a été générée par IA.

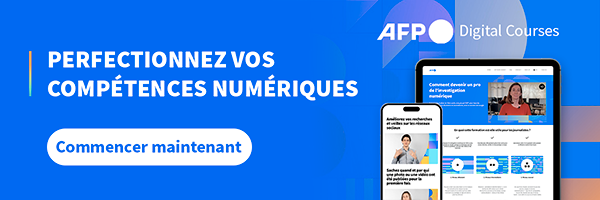

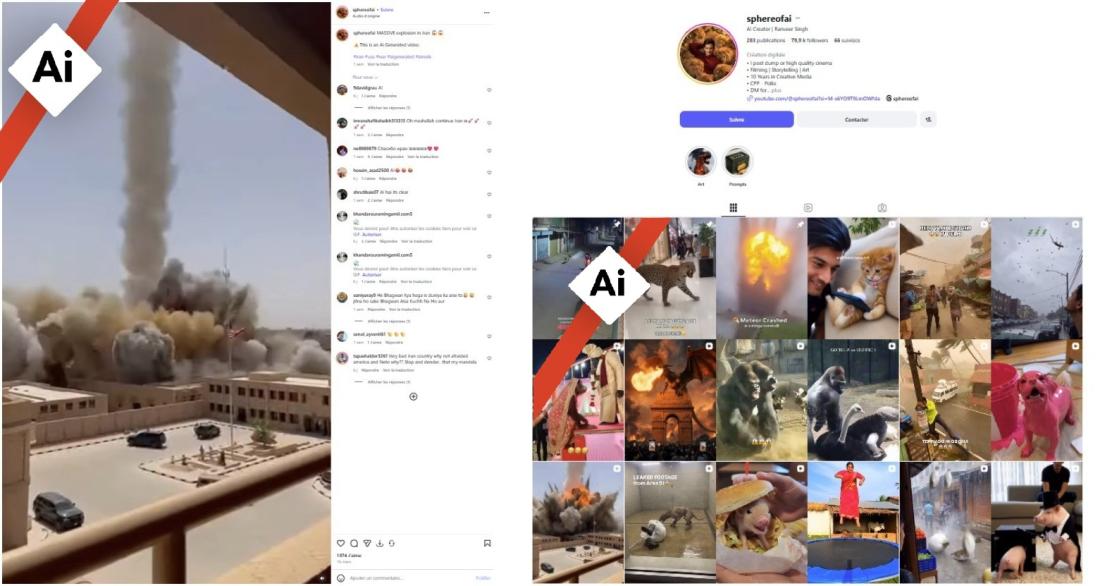

"LA BASE AMÉRICAINE AU QATAR est frappé par’l’IRAN [sic]", s'exclame un internaute en légende d'une vidéo publiée sur Facebook, le 17 mars 2026, comptant plus de 2.600 likes et des centaines de milliers de vues. "Ce n'est pas de l'IA", précise une mention placée sur la vidéo, sur laquelle on peut voir deux missiles s'abattre au milieu d'une cour entourée de clôtures barbelées. La présence de silhouettes à l'endroit de l'impact juste avant la frappe laisse supposer que ce bombardement aurait fait des blessés ou des morts.

On retrouve les mêmes images reprises mi-mars sur Facebook, X et Instagram, en français et en anglais mais aussi en turc, en arabe, en chinois, en bangali ou en télougou (sud de l'Inde), accompagnées de légendes similaires.

Des incohérences suspectes

En premier lieu, l'AFP n'a pas trouvé trace d'une frappe iranienne récente sur une installation militaire américaine au Qatar ayant causé des morts ou des blessés, et la source de la vidéo est inconnue.

La plupart des publications ne mentionnent pas le nom de la base américaine qui aurait été touchée, tandis que d'autres mentionnent la base aérienne d'Al-Udeid, siège du commandement militaire américain pour le Moyen-Orient (Centcom), au Qatar (lien archivé ici).

Celle-ci a bel et bien été touchée par un tir de missile iranien quelques jours après le début de la guerre - le 3 mars, près de quinze jours avant que les fausses vidéos ne soient mises en ligne, et celui-ci n'avait fait aucune victime (lien archivé ici), selon les autorités qataries.

Entre-temps, aucune frappe sur une installation militaire américaine au Qatar n'a été rapportée par les médias ou par les autorités qataries.

Le 17 mars, mais quoiqu'il en soit après la mise en ligne des publications trompeuses, le site internet proche des autorités iraniennes Press TV a indiqué les Gardiens de la Révolution avait "frappé avec succès" la base d'Al-Udeid au Qatar, en même temps qu'un autre grand nombre de cibles américaines ; cette information n'a été confirmée par aucune autre source, uniquement reprise par d'autres sites web et médias proches du gouvernement iranien.

L'AFP n'a pas trouvé trace de frappes iraniennes conduites sur une base militaire américaine (Al-Udeid ou autre) au Qatar ayant fait des morts ou des blessés durant la guerre en cours.

Outre la mort de sept militaires dans le Golfe et de six en Irak, l'armée américaine a recensé environ 200 blessés dans ses rangs, dont 10 "sérieusement", dans sept pays différents (lien archivé ici). Parmi les pertes de l'armée américaine, six soldats sont morts "lors d'une attaque de drones" iranienne à Port Shuaiba ; mais ceux-ci ont été tués au Koweït, et non au Qatar (lien archivé ici).

Outre ces éléments de contexte, plusieurs éléments mettent sur la piste d'une vidéo créée en utilisant un modèle de création par intelligence artificielle.

Le son est anormalement clair et ne subit aucune saturation ("clipping") telle qu'on peut en entendre sur des vidéos authentiques d'explosion filmées à l'aide d'un téléphone portable ; la rumeur que l'on peut entendre en fond s'interrompt brusquement juste avant la première frappe et une voix s'écrie : "Vous avez entendu ce 'boom' ?" alors qu'aucune explosion n'est encore audible.

Une vidéo identique

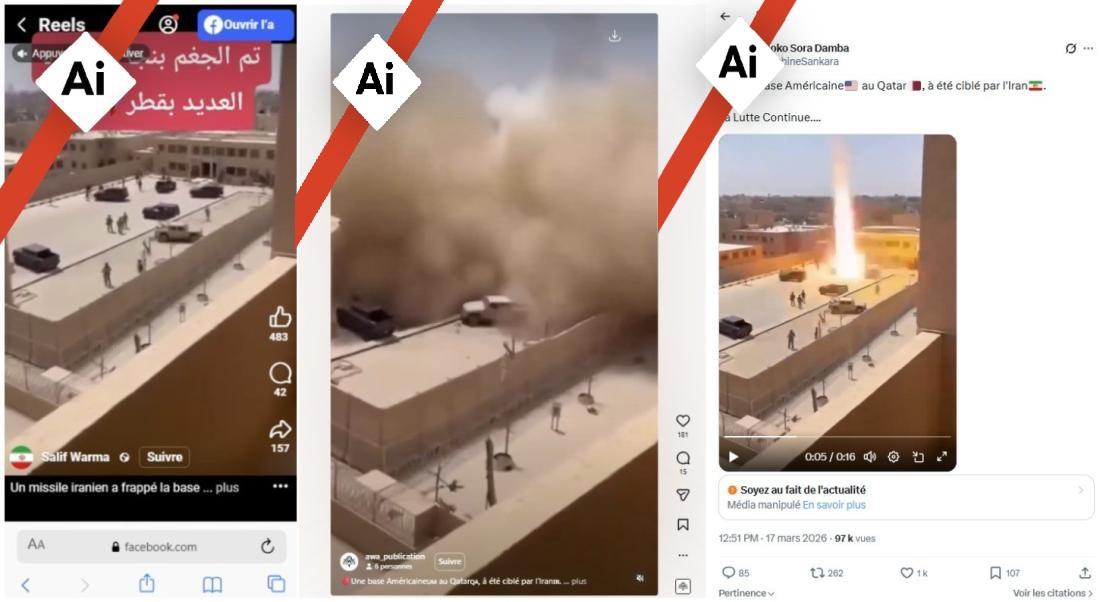

La vidéo présente aussi un certain nombre d'incohérences typiques de la création par IA. Le drapeau américain qui flotte au milieu de la cour disparaît ainsi totalement juste avant la première frappe.

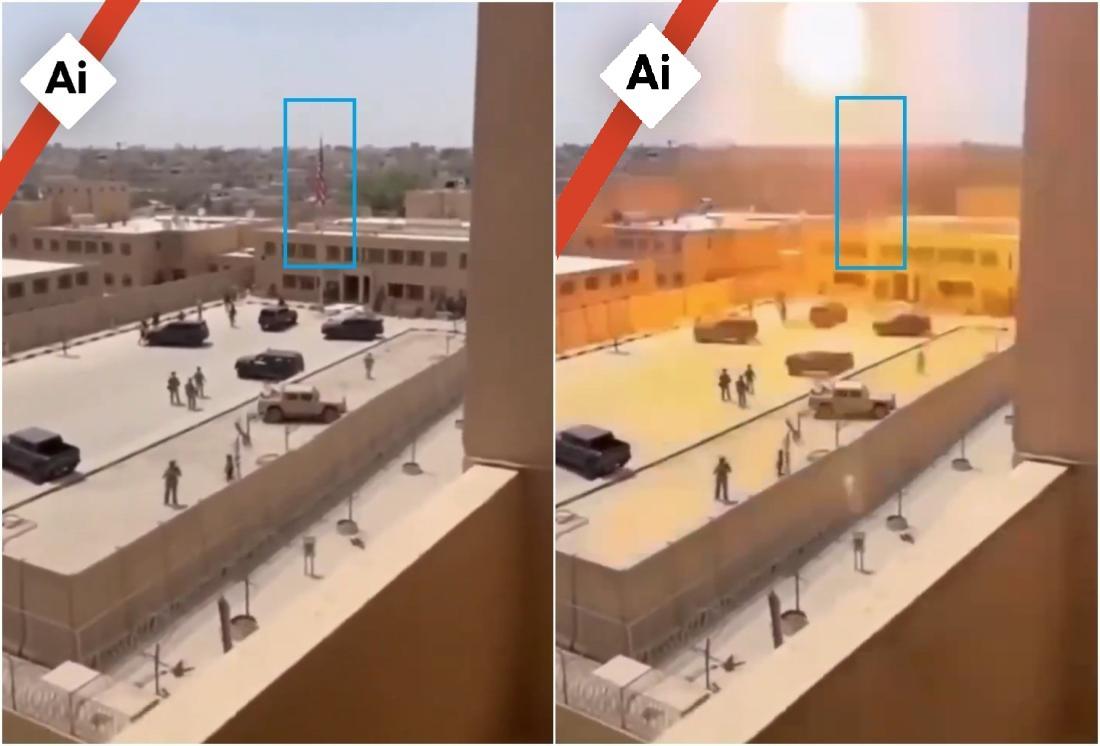

Et des débris projetés par la première explosion se comportent étrangement : ils changent plusieurs fois de forme avant de traverser le mur d'enceinte.

En raison du bruit de fond, les analyses audio qui permettent souvent de distinguer un son synthétique généré par IA ne permettent pas d'obtenir des résultats probants.

Des recherches d'images inversées conduisent en revanche à un grand nombre d'autres occurrences des mêmes images ailleurs sur internet ; or, certaines sont légèrement différentes, tout en ressemblant beaucoup à la vidéo trompeuse.

La vidéo dont elles sont issues a été mise en ligne le 16 mars par le compte "sphereofai", dédié à la diffusion de vidéos créées par IA, et inclut une mention "Cette vidéo a été générée par IA" (lien archivé ici).

On y retrouve les mêmes éléments d'une vidéo à l'autre : le balcon, l'angle de vue, les personnages et véhicules, le drapeau au centre de la cour, le nombre de frappes et les nuages de fumée, laissant penser qu'il s'agit de deux vidéos générées avec les mêmes instructions sur un modèle de création IA.

Contacté par l'AFP, le propriétaire du compte n'avait pas répondu à la publication de cet article.

Frappes aériennes et désinformation

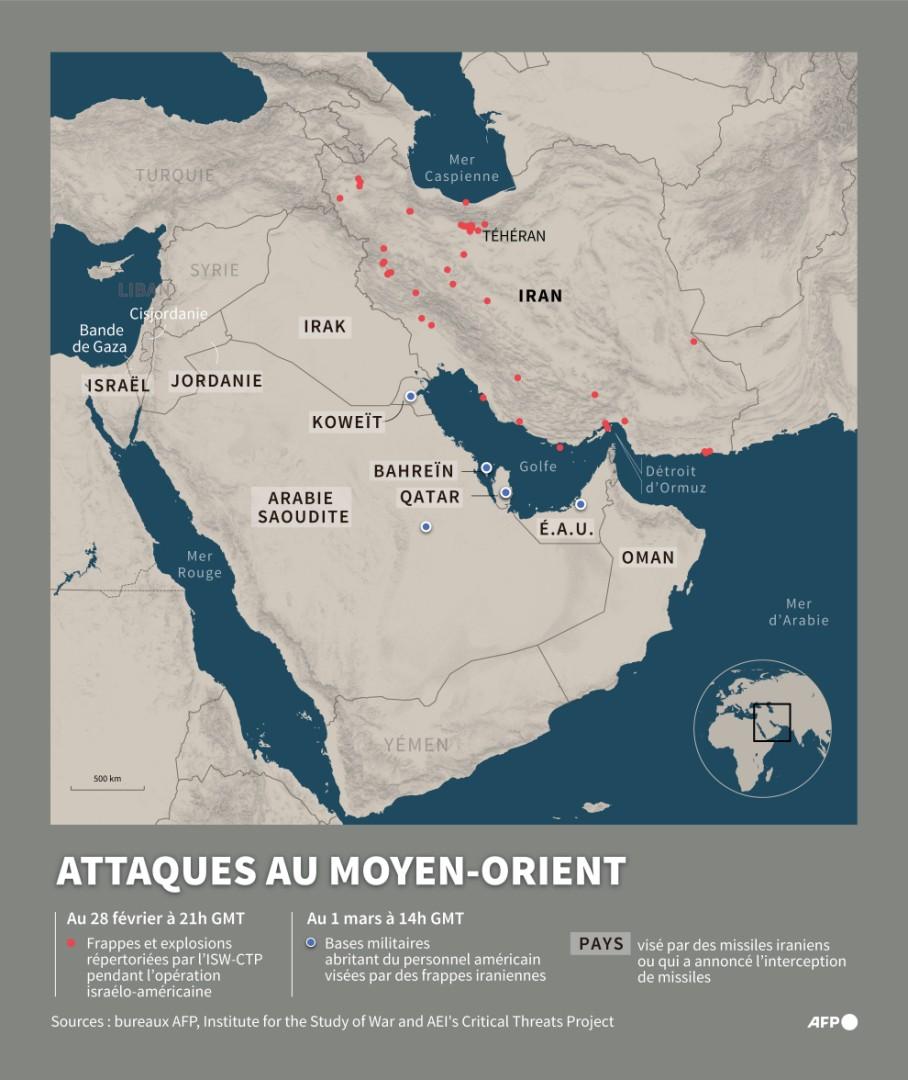

Depuis que les Etats-Unis et Israël ont lancé des frappes contre l'Iran le 28 février, la guerre a gagné l'ensemble de la région et fait des victimes dans plusieurs pays du Moyen-Orient. L'Iran, Israël et les Etats-Unis poursuivent leurs frappes de missiles alors que le doute plane sur d'éventuelles négociations en vue d'un cessez-le-feu (lien archivé ici).

L'Iran subit des frappes sur ses installations militaires et énergétiques, tandis que la capitale Téhéran est régulièrement la cible de tirs. En réaction, le pays multiplie les attaques de missiles à moyenne portée et de drones visant les pays du Golfe afin de faire pression sur les Etats-Unis, dont il cible également les bases militaires dans la région.

Parallèlement, une guerre de la désinformation fait rage en ligne, les partisans de chaque camp tentant de tirer parti du flux d'images constant entourant le conflit sur les réseaux sociaux. L'intelligence artificielle générative y joue un rôle central en facilitant la création et la propagation de fausses vidéos à des fins de propagande.

Les agents conversationnels IA, par lesquels s'informe une part croissante de la population, peuvent également amplifier la portée des fausses informations : comme en de nombreuses autres occasions depuis le début de la guerre, le chatbot de X, Grok, a ainsi assuré à des internautes qui lui posaient la question que la vidéo en question était bien authentique.

Ces erreurs illustrent les limites des robots conversationnels, qui peuvent produire des réponses incohérentes en fonction du moment ou de la formulation d'une question. Ces chatbots ont des biais, soulignent les experts, qui proviennent de deux grandes sources : leurs données d'entraînement, qui conditionnent la base des connaissances du modèle, et la phase d'alignement, qui détermine ce que le modèle considère comme une "bonne" ou une "mauvaise" réponse.

Depuis le début de la guerre, ceux-ci ont à plusieurs reprises démontré leur incapacité à reconnaître une vidéo générée par IA.

Le conflit actuel au Moyen-Orient fait l'objet d'une désinformation massive sur les réseaux sociaux. De nombreuses autres générées par IA ont été vérifiées par l'AFP dans ce contexte, comme ici, ici et là.

Retrouvez tous les articles de vérification de l'AFP consacrés à la guerre et à l'Iran ici.

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.