"Etat islamique", keffieh et drapeau français lacéré : gare à ces fausses vidéos, attribuées à des campagnes d'ingérence russe

- Publié le 19 septembre 2025 à 15:26

- Lecture : 7 min

- Par : Dounia MAHIEDDINE, AFP France

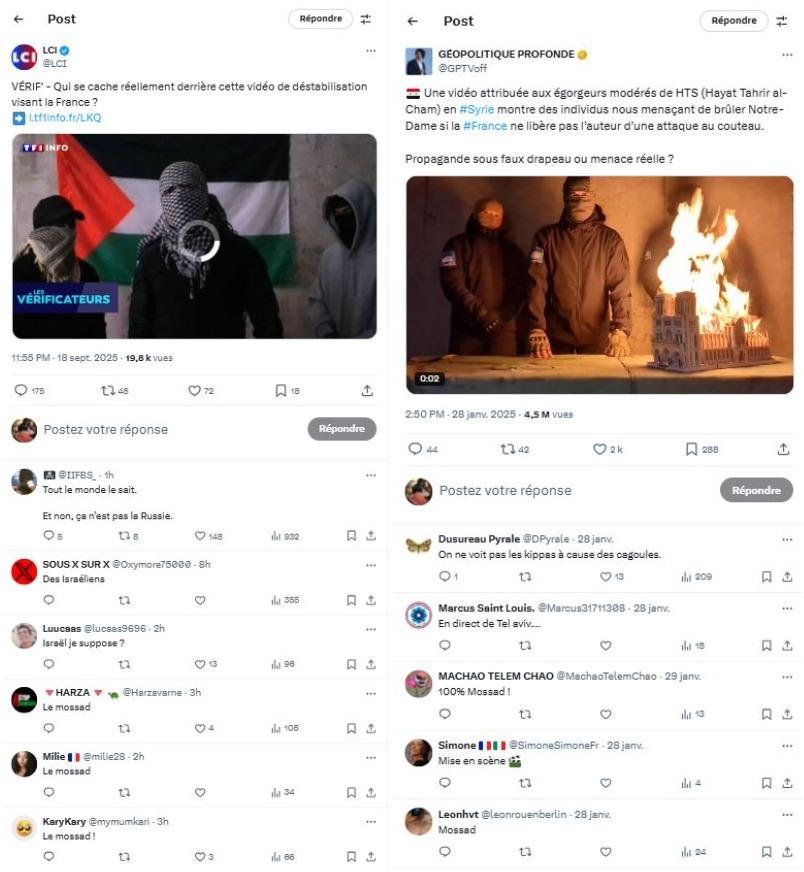

Depuis le 14 septembre, la vidéo d’une vingtaine de secondes circule sur les réseaux sociaux. On y voit trois hommes masqués, décrits tantôt comme des "migrants clandestins", tantôt comme des "musulmans pro-palestiniens", proférant en arabe des menaces directes contre la France. Filmés devant un mur neutre orné d’un drapeau palestinien, ils s’adressent à "la population française", accusent le gouvernement d’être "corrompu" et "incapable de [les] protéger". Ils promettent de transformer le pays en "État islamique", "si Dieu le veut", avant de déchirer le drapeau tricolore.

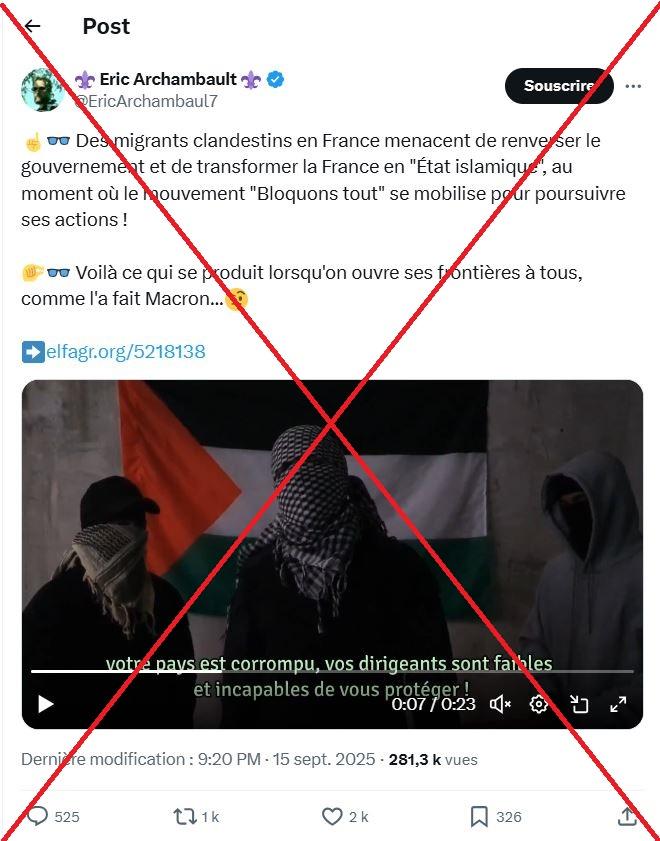

Partagée notamment sur X (1,2,3,4), cette séquence a été reprise par des comptes identifiés comme relais de contenus extrémistes ou véhiculant de la désinformation. Un internaute y voit une preuve que "les frontières ouvertes par Macron" mèneraient à "l’effondrement du pays".

Le 16 septembre, les autorités françaises ont confirmé à l’AFP que ces trois séquences s’inscrivaient bien dans le schéma d’ingérence numérique connu sous le nom de Storm-1516. L'AFP y a consacré plusieurs papiers ici, ici et ici.

En effet, plusieurs éléments permettent de douter fortement de l’authenticité de cette vidéo, et suggèrent qu’il s’agit d’une mise en scène qui s'inscrit dans une campagne plus large de manipulation de l’opinion publique.

Ces vidéos sont par essence difficiles à vérifier : elles ne comportent ni logo identifiable, ni décor reconnaissable, et les visages des protagonistes sont masqués. Cependant, certains éléments permettent de nourrir de sérieux doutes sur leur authenticité. En retraçant l’origine des publications et en observant les comptes qui les relaient, on peut reconstituer un faisceau d’indices.

C'est le cas ici : la séquence ne semble provenir d’aucune chaîne officielle de groupes djihadistes connus, ni de médias affiliés à leurs réseaux. Une analyse du mode de diffusion révèle également une stratégie de dissémination par paliers : d’abord relayée dans des sphères peu visibles, la vidéo est ensuite amplifiée par des comptes plus populaires, notamment dans la droite radicale francophone.

"Les vidéos authentiques viennent des canaux officiels des groupes, de fondations médiatiques officielles. De manière générale, les vidéos des groupes djihadistes (al-Qaida, Etat islamique) ou Hamas sont beaucoup plus travaillées, éditées. Le fait de ne mentionner aucune organisation précise peut en effet être un signe de manipulation", estime Laurence Bindner, cofondatrice de JOS Project, structure d’analyse de la propagande extrémiste violente et des discours radicaux (lien archivé ici).

L’une des premières personnes à avoir relayé la vidéo sur X est Eric Archambault, YouTubeur et soutien de la Russie, connu pour diffuser de la désinformation. Son post renvoie au journal indépendant égyptien elfagr.org, qui établit un lien entre cette fausse vidéo et les manifestations du 10 septembre en France.

En remontant le fil, l'AFP a pu retrouver ce qui apparaît comme la toute première publication sur X, faite par un utilisateur nommé "Omar Azul", dont la biographie mentionnait en arabe "la résistance islamique". Le post a depuis été supprimé, mais le compte est toujours actif.

Des mises en scène grossières

Des détails dans la vidéo posent aussi question : les tenues sont dépareillées (un sweatshirt à capuche, une casquette, des kieffeh...). De plus, aucun des individus ne mentionne d’organisation précise, et le discours tient davantage de l’intimidation brute que d’un manifeste politique ou religieux.

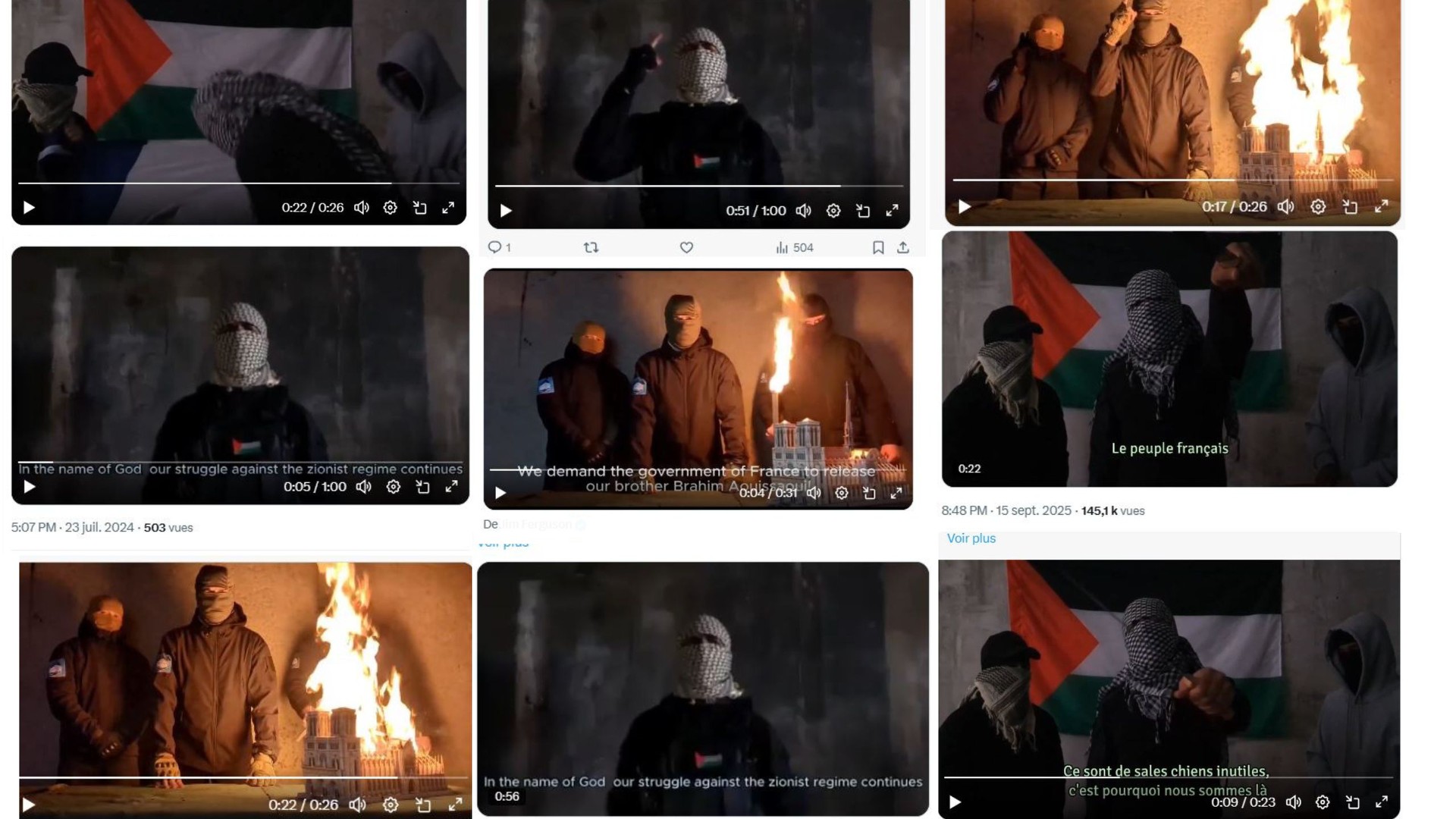

Ce n’est pas la première vidéo de ce type à circuler sur les réseaux sociaux. Au moins deux autres séquences similaires ont été recensées :

- En juillet 2024, une vidéo attribuée à des membres du Hamas menaçait de perturber les JO de Paris et montrait une figure de Marianne décapitée.

- En janvier, puis début septembre 2025, une autre montrait des hommes se revendiquant du groupe islamiste Hayat Tahrir al-Cham (HTS) menaçant de brûler la cathédrale Notre-Dame si la France ne libérait pas un prisonnier.

Le mode opératoire reste le même : viser un symbole fort de l’identité française - Marianne, Notre-Dame, drapeau tricolore. "Ce sont des symboles simples et compris de tous. Les attaquer suscite une réaction émotionnelle plus forte, notamment chez les identitaires", explique Laurence Bindner.

Selon l’experte, chaque vidéo se place dans un contexte politique particulier : la vidéo des JO visait à "alimenter la peur des attentats alors que la dissolution de l’Assemblée avait eu lieu". La séquence de HTS a émergé au moment où la France et la Syrie d’Al-Sharaa s’apprêtaient à renouer des relations diplomatiques : "Cette vidéo fait d’une pierre deux coups : elle suscite la défiance chez les identitaires, et tente de décrédibiliser HTS, qui avait renversé Bachar al-Assad, allié de Poutine. "

Quant à la toute dernière vidéo, que nous examinons ici, elle survient quelques jours avant la reconnaissance de la Palestine par la France et "tente de capitaliser sur la fracture politique et sociétale que cette décision suscite", précise Mme Bindner. "Le timing n’est pas innocent : ces vidéos apparaissent en période d’instabilité politique et de tensions sécuritaires potentielles." (Lien archivé: ici)

Pour l’experte, les objectifs sont multiples : réactiver la psychose du terrorisme djihadiste, exacerber la crainte d’un conflit de civilisation - notamment en ciblant Notre-Dame - et capitaliser sur les tensions liées au conflit Israël-Hamas pour accentuer les divisions intercommunautaires, profondément ressenties en France depuis le 7 octobre 2023 et le début de la guerre à Gaza.

Ces vidéos, loin d’être de simples contenus viraux, s’inscrivent en réalité dans une stratégie soigneusement orchestrée connue sous le nom de Storm-1516. D’après Viginum, l’organisme français chargé de surveiller les manipulations étrangères en ligne, cette campagne de désinformation est attribuée à des acteurs russes et est apparue en marge de la guerre en Ukraine.

Entre août 2023 et mars 2025, pas moins de 77 opérations de désinformation ont été détectées, ciblant à la fois l’Ukraine et les pays qui la soutiennent, dont la France. Selon Viginum, ce dispositif est "particulièrement complexe, adaptable et redoutablement efficace" pour propager des récits hostiles à l’Ukraine et à l’Occident.

Selon Darren L. Linvill, professeur à l’université de Clemson, spécialiste de la désinformation sur les réseaux sociaux et de son impact sur le débat public, ces vidéos, bien que très simples en apparence, sont soigneusement conçues, notamment pour préserver l’anonymat des participants. "Beaucoup de vidéos authentiques d’extrémistes islamistes sont également anonymes, mais il arrive qu’ils montrent leur visage ou un indice de leur localisation. Les fausses vidéos, elles, ne le font jamais" explique-t-il. Il souligne également que les tenues portées par les auteurs sont souvent dépourvues de tout élément personnel permettant de les identifier (lien archivé ici).

L’expert ajoute que se faire passer pour un groupe extrémiste précis est plus difficile que de créer un collectif générique. "C’est cette combinaison d’anonymat et de symboles forts qui rend ces vidéos à la fois rudimentaires et redoutablement efficaces", conclut Linvill.

"Pointer la mauvaise cible"

Selon Laurence Bindner, la simplicité apparente de certaines vidéos constitue une stratégie réfléchie. Selon elle, "c’est intéressant pour eux de faire des vidéos très rudimentaires parce que c’est très facile à faire, ça ne coûte pas cher et puis hop, ils balancent ça en ligne".

Mais cette rapidité joue un double rôle : elle facilite la diffusion et provoque des réactions en ligne, souvent conspirationnistes. "Le fait que ce soit tellement rudimentaire, ils savent très bien que ça va susciter des réactions conspirationnistes. Ces vidéos sont censées attiser des peurs, notamment l’islamophobie, et les internautes pointent souvent des cibles erronées, comme les services secrets israéliens" accusés d'avoir créé cette vidéo, ajoute l’experte.

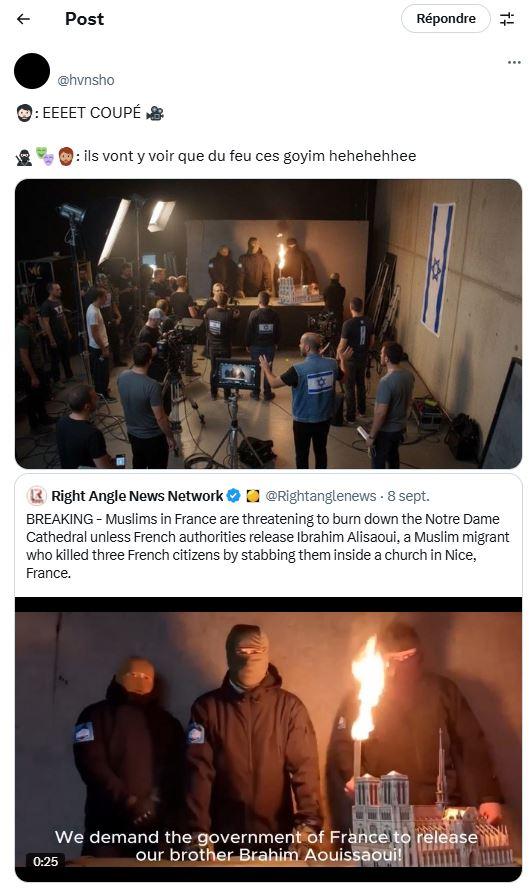

"Vous allez voir que d'ici peu on verra que c'est Israël derrière tout ça...", écrit par exemple un internaute en commentaire d'une des publications virales. "Spécialité des sionistes", "On ne voit pas de kippas à cause des cagoules", "Réalisation Tel-Aviv production", "Encore une pub du Mossad", peut-on par exemple lire sous les publications de ces vidéos.

Dans la même veine, une image très probablement générée par intelligence artificielle circule également, montrant les trois hommes cagoulés posant à côté de la maquette de Notre-Dame. Dans cette version, des drapeaux israéliens et des caméras autour du trio ont été rajoutés, comme pour "prouver" une mise en scène attribuée au Mossad.

Pour Laurence Bindner, l’objectif n’est donc pas seulement de faire peur : ces vidéos exploitent les émotions et les réactions pour détourner l’attention et amplifier les tensions. "Ils font un truc rudimentaire parce que c’est facile à produire, mais aussi parce que les réactions qui vont être charriées derrière vont pointer une mauvaise cible du doigt", conclut-elle.

"Colère" et "division"

L’originalité de Storm-1516 réside dans ses méthodes : recours à l’intelligence artificielle pour générer des visages et discours, utilisation d’acteurs rémunérés, diffusion via des influenceurs pro-russes (comme l’ex-militaire français Adrien Bocquet) ou pro-MAGA "Make America Great Again" slogan des Trumpistes) américains, puis "blanchiment" des contenus par des médias relais.

Selon le professeur Darren L. Linvill, ces récits inventés "s’appuient sur des clichés racistes et diffusent la colère et la division".

"Les stéréotypes qu’ils mettent en avant sont conçus pour dire à un public spécifique exactement ce qu’il veut entendre. Quand on dit à quelqu’un ce qu’il a envie d’entendre, il y croit et il le partage", explique-t-il.

M. Linvill détaille aussi les outils employés : "Premièrement, ils utilisent des influenceurs prêts à publier du contenu contre rémunération. Deuxièmement, ils placent leurs histoires dans des médias d’État russes ou étrangers. Troisièmement, ils mobilisent des think tanks ou des ONG liées au Kremlin."

L’objectif final, selon lui, reste interne : consolider le pouvoir du président russe Vladimir Poutine. "Plus il parvient à présenter l’Occident comme divisé et incompétent aux yeux de son peuple, moins celui-ci remettra en cause son autorité."

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.