Cette vidéo prétendant montrer un missile frapper Tel-Aviv a été générée par IA

- Publié le 4 mars 2026 à 18:36

- Lecture : 5 min

- Par : Charlotte DURAND, AFP Afrique

Depuis l'attaque israélo-américaine du 28 février contre l'Iran, la guerre a embrasé le Moyen-Orient. Téhéran, toujours sous le feu nourri des bombes, poursuit en représailles ses frappes sur des cibles américaines dans les pays du Golfe et des villes israéliennes. Une vidéo devenue virale sur les réseaux sociaux prétend montrer un "missile hypersonique" iranien frapper la ville israélienne de Tel-Aviv. Mais cette séquence a très probablement été générée par IA, comme l'indiquent certains détails visuels et sonores, ainsi que des logiciels spécialisés dans la détection de ce type de contenus.

Les Etats-Unis et Israël ont mené fin février une attaque conjointe sans précédent sur l'Iran, après des semaines de menaces d'intervention militaire. Ces frappes ont tué le guide suprême iranien Ali Khamenei, à la tête de la République islamique depuis 36 ans (dépêche AFP archivée ici).

De son côté, l'Iran, qui se trouve toujours sous les bombes israélo-américaines, poursuit ses frappes sur des cibles américaines, notamment dans les pays du Golfe, et sur des points stratégiques israéliens (dépêche AFP archivée ici).

Dans ce contexte, une vidéo circulant depuis le 4 mars prétend montrer une frappe iranienne sur Israël.

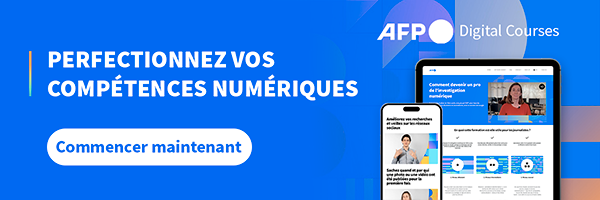

"Un résident de Tel-Aviv a filmé depuis son balcon le passage d’un missile hypersonique lors de la salve iranienne qui secoue actuellement Israël", affirme une publication sur Facebook, qui cumule plus de 3.400 mentions "j'aime" en quelques heures.

Cette séquence a été vastement reprise ailleurs sur Facebook (1,2,3), mais aussi sur X ou encore Instagram. Elle circule aussi avec des affirmations similaires dans d'autres langues, notamment en arabe, en turc et en anglais.

Mais en réalité, cette séquence a très vraisemblablement été générée par IA, comme le montrent des indices visuels et sonores, ainsi que des logiciels spécialisés dans la détection de ce genre de contenus.

Incohérences visuelles et sonores

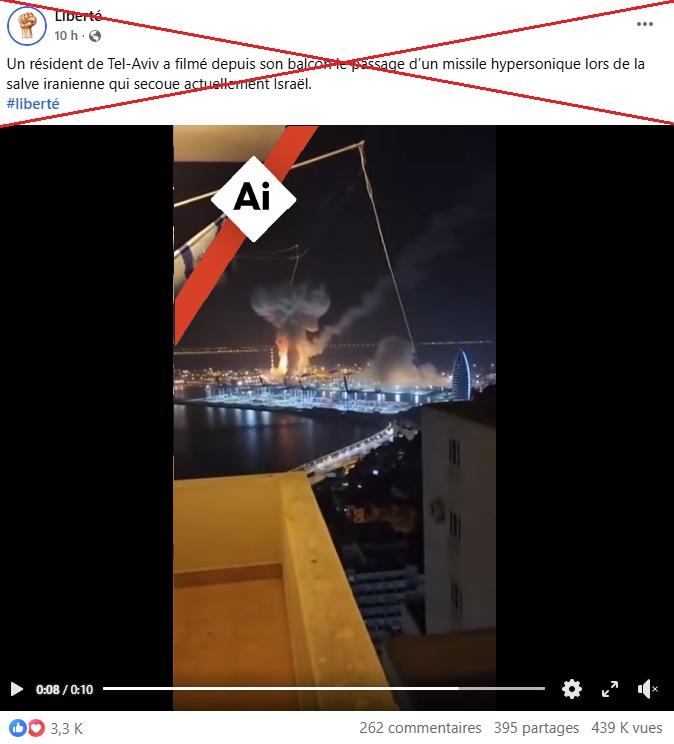

En premier lieu, la ville montrée dans la vidéo ne ressemble pas à Tel-Aviv. En particulier, le gratte-ciel en forme d'obus visible à droite de l'écran ne correspond pas à un bâtiment connu de la skyline de cette ville.

Une recherche d'image inversée sur cette tour nous conduit vers divers résultats, depuis la Rose Tower de Dubaï au Yyldyz Hotel à Ashgabat, au Turkménistan, mais ne donne rien concernant Tel-Aviv. En revanche, le building ressemble à la Sail Tower de Haifa, le deuxième plus grand gratte-ciel de cette autre ville israélienne. Il est en effet situé près d'installations portuaires, comme on peut le voir sur la vidéo.

L'échange en hébreu au sein de la vidéo mentionne d'ailleurs la ville de Haifa ("Vous voyez la fumée là-bas, au-dessus de Haïfa ? Quelque chose brûle là-bas..."), et non Tel-Aviv. Cette première incohérence suscite déjà des doutes.

Il pourrait s'agir d'une vidéo décontextualisée, car des frappes ont en effet été menées par le Hezbollah pro-iranien - et non l'Iran directement - contre la base navale de Haïfa, dans la nuit du mardi 3 mars. L'armée israélienne a indiqué avoir détecté plusieurs projectiles et intercepté la plupart d'entre eux (dépêche AFP archivée ici).

Cependant, si on écoute attentivement le son de la vidéo, deux indices font douter de sa véracité. Tout d'abord, les voix en hébreu ont un débit très haché, voire robotique, comme c'est souvent le cas dans les contenus générés par IA.

Ensuite, comme le font remarquer plusieurs internautes, le son de l'explosion arrive en même temps que l'image, alors que la cible touchée est à bonne distance. Or, le son se déplace plus lentement que la lumière dans l'air : comme c'est le cas lors des orages, on voit d'abord les explosions, puis le son arrive lui quelques secondes après, en fonction de la distance. On le constate dans de nombreuses réelles vidéos de bombardements, comme dans ces images de frappes israéliennes à Beyrouth filmées le 4 mars 2026 par l'AFP.

On observe aussi des incohérences visuelles majeures : le drapeau situé sur le balcon continue d'osciller au même rythme tout au long de la vidéo, même lorsque la caméra bouge au moment supposé de l'onde de choc liée à l'explosion. De même, l'eau de la baie ne réagit pas à la frappe, pourtant arrivée à proximité, et reste bien lisse.

A noter que des drapeaux sont souvent inclus dans des contenus générés par IA lorsque le prompt initial comporte un nom de pays, car c'est un moyen facile pour l'intelligence artificielle de représenter le pays. C'était le cas dans de nombreux autres contenus de ce type que l'AFP a vérifié, comme ici, ici ou encore ici.

L'aspect de la vidéo est aussi très "parfait" et "lisse", notamment le champignon de l'explosion, ce qui est un signe typique des contenus générés par IA.

99% de chances d'avoir été généré par IA

Pour avoir plus d'informations, on consulte aussi des détecteurs de contenus générés par IA.

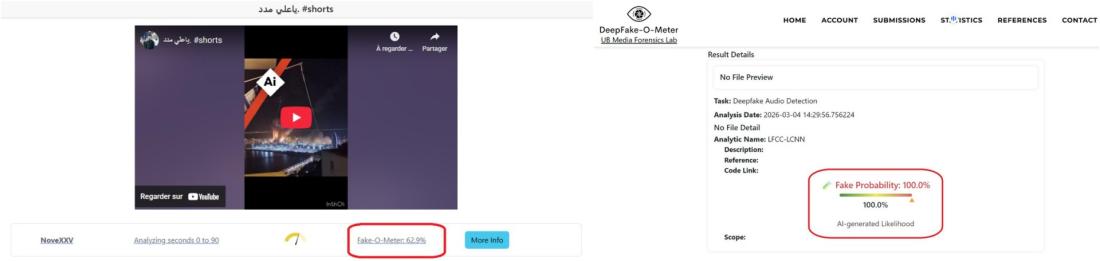

L'outil d'analyse audio DeepfakeTotal estime ainsi que le son de la vidéo que nous étudions a plus de 60% de chance d'avoir été généré par cette technologie. Une autre vérification lancée sur l'outil DeepFake-O-Meter, développé par l'Université de Buffalo à New York, est beaucoup plus catégorique, estimant la probabilité à 100%.

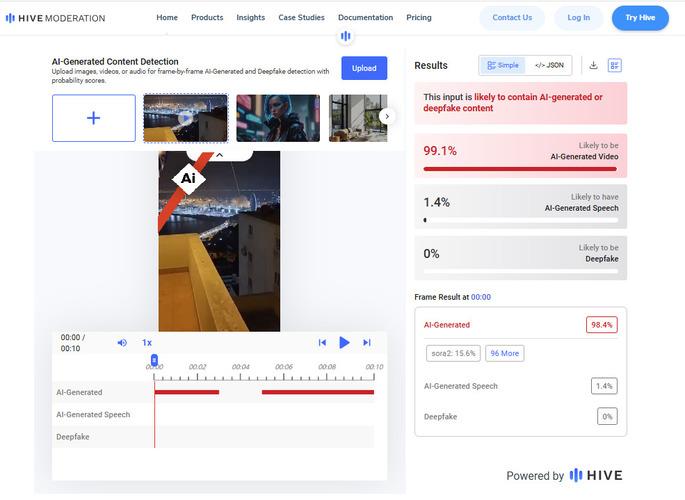

Du côté des images, l'outil de détection Hive moderation estime que la vidéo a 99,1% de chances d'avoir été générée par IA.

Des analyses lancées sur l'outil InVID-WeVerify à partir d'images-clef tirées de la vidéo concluent aussi selon trois méthodes différentes qu'elle aurait été générées de façon synthétique.

Guerre de la désinformation

Cette vidéo est un énième exemple de la guerre de la désinformation qui fait rage ces derniers jours sur Internet, en parallèle des développements militaires. Les deux camps et leurs partisans inondent les réseaux sociaux de contre-vérités, qui se propagent souvent plus vite que les faits authentiques (dépêche AFP archivée ici).

Les équipes de l'AFP ont ainsi identifié une série de comptes pro-iraniens qui publiaient des vidéos anciennes destinées à exagérer les dégâts des frappes de Téhéran contre Israël et les Etats du Golfe. De l'autre côté du spectre, selon des chercheurs, des médias de l'opposition iranienne ont diffusé sur X et Telegram des récits imputant, à tort, une frappe contre une école de filles en Iran au gouvernement iranien lui-même.

"Il y a clairement une guerre des récits en ligne", explique à l'AFP Moustafa Ayad, de l'Institut pour le dialogue stratégique (ISD). "Qu'il s'agisse de justifier les frappes dans le Golfe ou de vanter la puissance militaire iranienne face aux attaques israéliennes et américaines, les objectifs semblent être d'user les +ennemis+".

AFP Factuel a de son côté vérifié en plusieurs langues des dizaines de fausses informations diffusées depuis le début de la guerre, allant de vidéos décontextualisées, comme ici, ici ou ici, à des contenus générés par IA (comme ici ou là).

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.