Des vidéos IA censées prouver la mort de Benjamin Netanyahu ? C'est faux

- Publié le 19 mars 2026 à 17:49

- Mis à jour le 31 mars 2026 à 12:54

- Lecture : 13 min

- Par : Cintia NABI CABRAL, Pierre MOUTOT, AFP France

Le 12 mars 2026, le Premier ministre israélien Benjamin Netanyahu a fait sa première allocution depuis le début de l'offensive israélo-américaine contre l'Iran. Dans la foulée, des internautes ont affirmé que la vidéo serait générée par intelligence artificielle (IA), preuve selon eux que le dirigeant israélien serait mort. Face à l'ampleur de cette rumeur, Benjamin Netanyahu est apparu dans une vidéo pour prouver qu'il était bien en vie - mais celle-ci a également été remise en question. Mais ces affirmations sont infondées, comme l'ont expliqué des spécialistes de l'IA et des vérifications de l'AFP. De plus, le responsable israélien a fait plusieurs apparitions récentes.

Dans la soirée du 12 mars, la chaîne télévisée BFMTV diffuse, en direct, des images de Benjamin Netanyahu revenant sur l'opération militaire Roaring Lion qui vise l'Iran depuis le 28 février, conjointement avec les Etats-Unis (lien archivé ici).

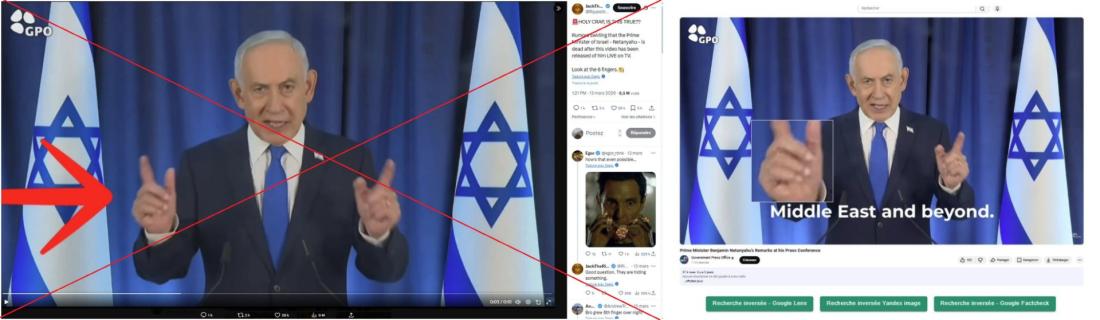

Mais en ligne, des internautes ont mis en doute l'authenticité des images relayées par la chaîne : d'après eux, l'extrait serait une vidéo générée par IA car le dirigeant israélien aurait "six doigts" visibles sur certains plans (lien archivé ici).

Les mains déformées par les IA génératives -notamment avec six doigts- figuraient parmi les anomalies les plus fréquentes permettant de détecter l'usage de l'IA générative grand public à ses débuts en 2023-2024 dans la foulée du lancement de ChatGPT. Des anomalies de ce genre peuvent encore apparaître mais sont de moins en moins fréquentes à mesure que les logiciels d'IA génératives se perfectionnent.

"Non mais vous êtes sérieux BFM-WC @BFMTV de foutre du 100% IA à la téloche ? Le type a des doigts avec du pouce à l'auriculaire complètement identiques, et pire, il y a même un passage où il se retrouve avec 6 doigts...", s'indigne un internaute sur X dans une publication partagée plus de 4.000 fois et cumulant près de 6 millions de vues depuis le 13 mars.

Des messages similaires, avec les mêmes images à l'appui, circulent sur Facebook, Instagram, Threads, TikTok, X, et dans plusieurs langues, notamment en anglais, en allemand, en espagnol, en filipino, en portugais et en suédois, générant des dizaines de milliers de commentaires selon lesquels des aberrations sur la vidéo prouveraient qu'elle a été générée par intelligence artificielle.

La rumeur n'est pas nouvelle : le 10 mars, l'agence semi-officielle iranienne Tasnim a publié un article largement relayé par des médias iraniens proches du pouvoir, faisant courir le bruit d'une possible mort du Premier ministre israélien (lien archivé ici).

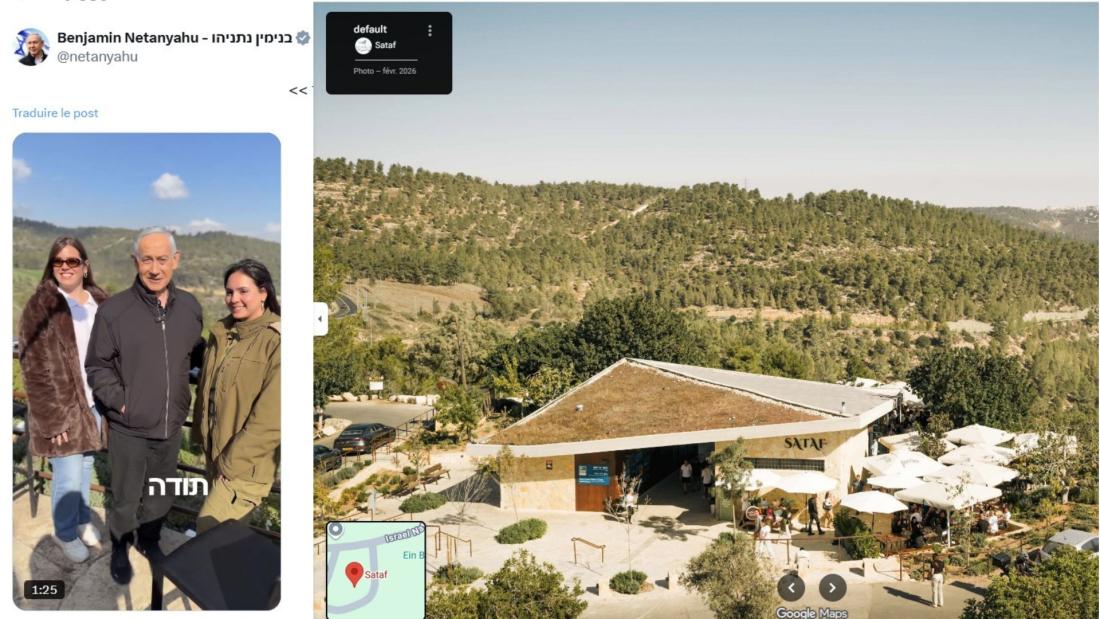

L'ampleur prise par cette infox a incité les autorités israéliennes à réagir : quelques jours plus tard, une vidéo de démenti est publiée sur le compte X du Premier ministre israélien, où l'on voit Benjamin Netanyahu dans un café près de Jérusalem, plaisantant sur les rumeurs concernant sa mort et même sur le nombre de ses doigts (liens archivés ici, ici et ici).

Mais là encore, la vidéo est massivement partagée et commentée par des internautes persuadés d'y voir un nouveau faux, lui aussi généré par IA.

En réalité, ces images n'ont vraisemblablement pas été générées par intelligence artificielle, comme le montrent des vérifications menées par l'AFP et des entretiens avec des spécialistes des contenus générés par IA.

L'AFP n'a par ailleurs pas trouvé trace de source crédible faisant état de la mort ou de blessures de Benjamin Netanyahu.

Celui-ci est à nouveau apparu le 17 mars à l'occasion d'une déclaration pour confirmer la mort d'Ali Larijani, puissant haut responsable de la République islamique et chef de la sécurité (lien archivé ici).

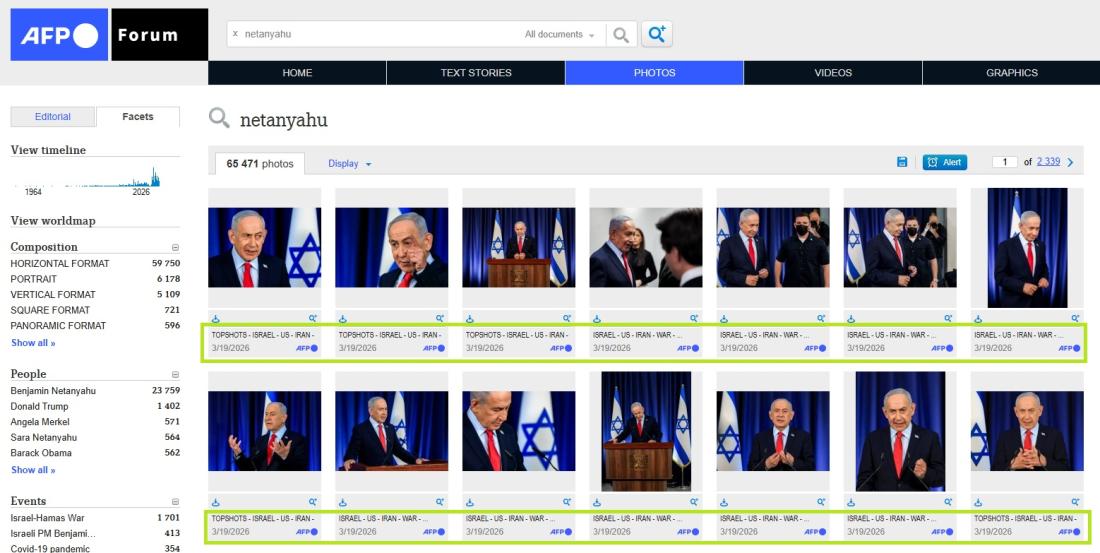

Le 19 mars, Benjamin Netanyahu a été vu par des journalistes lors d'une conférence de presse, où il a évoqué les rumeurs concernant sa mort : "Avant toute chose, je tiens à dire que je suis vivant, et vous en êtes tous témoins", a-t-il déclaré à partir de la minute 9:22 de cette diffusion en direct (liens archivés ici, ici et ici).

De nombreuses photos de cette rencontre entre le dirigeant israélien et la presse internationale sont disponibles sur AFP Forum, la plateforme de distribution de l'AFP (lien archivé ici).

Une vidéo authentique

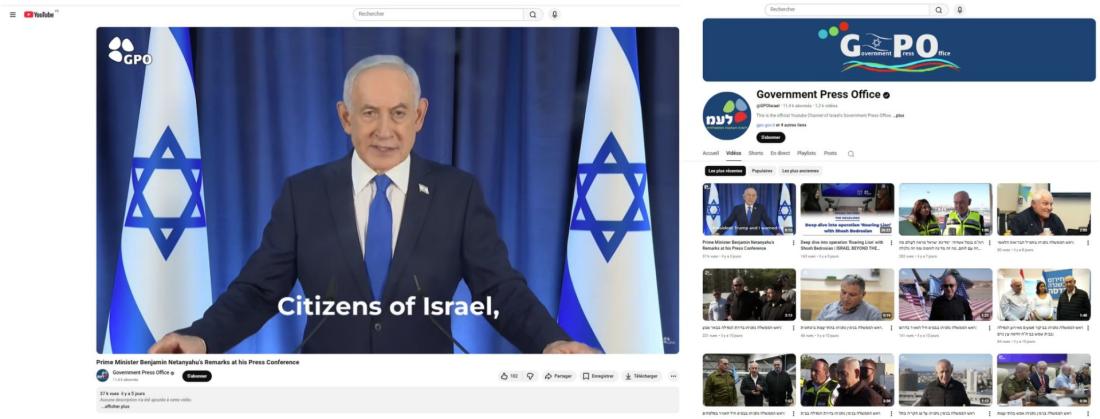

Une recherche par mots-clés a permis à l'AFP de retrouver la source de la vidéo dont est partie l'infox. Elle a été publiée dès le 12 mars 2026 sur YouTube sous le titre "Prime Minister Benjamin Netanyahu's Remarks at his Press Conference" (lien archivé ici).

Celle-ci a été publiée par le canal Government Press Office, la chaîne YouTube officielle du service de presse du gouvernement israélien (lien archivé ici). À première vue, rien ne la distingue d'autres allocutions passées du Premier ministre visibles sur la chaîne.

Mais des internautes ont affirmé que Benjamin Netanyahu aurait plus de cinq doigts à une main sur certains plans : entre 2023 et 2024, cette diffuculté pour certains modèles de génération d'image par IA à représenter des mains humaines de manière réaliste est devenue à ce moment là l'une des façons les mieux connues de distinguer une fausse vidéo.

Pourtant, un examen image par image montre qu'à aucun moment le Premier ministre israélien ne semble avoir plus de cinq doigts à chaque main, même si sa main semble parfois un peu floue. Ce signe est par ailleurs devenue obsolète pour déterminer si la vidéo a été créée par IA, ont confirmé à l'AFP Henry Ajder, spécialiste dans l'étude des contenus synthétiques et des deepfakes, et Evangelos Kanoulas, professeur d'intelligence artificielle à l'université d'Amsterdam (liens archivés ici et ici).

"Dans le cas d'une vidéo générée par IA, des aberrations et des incohérences tendent généralement à apparaître d'un plan à l'autre", a expliqué Angelos Kanoulas à l'AFP le 17 mars, "et il s'agit là d'une seule personne, d'un seul plan, ce qui serait donc le plus simple à générer".

"Il y a du mouvement avec les mains, et dans n'importe quelle vidéo les changements d'une image à l'autre peuvent créer cette impression de flou", a-t-il analysé, en pointant qu'"il suffit d'une capture d'écran sur un moment où on passe d'un plan à l'autre, surtout si la vidéo est compressée, car elle perd en qualité et donc en définition, en détail".

Une comparaison avec la vidéo originale, de meilleure qualité, permet également de s'en assurer.

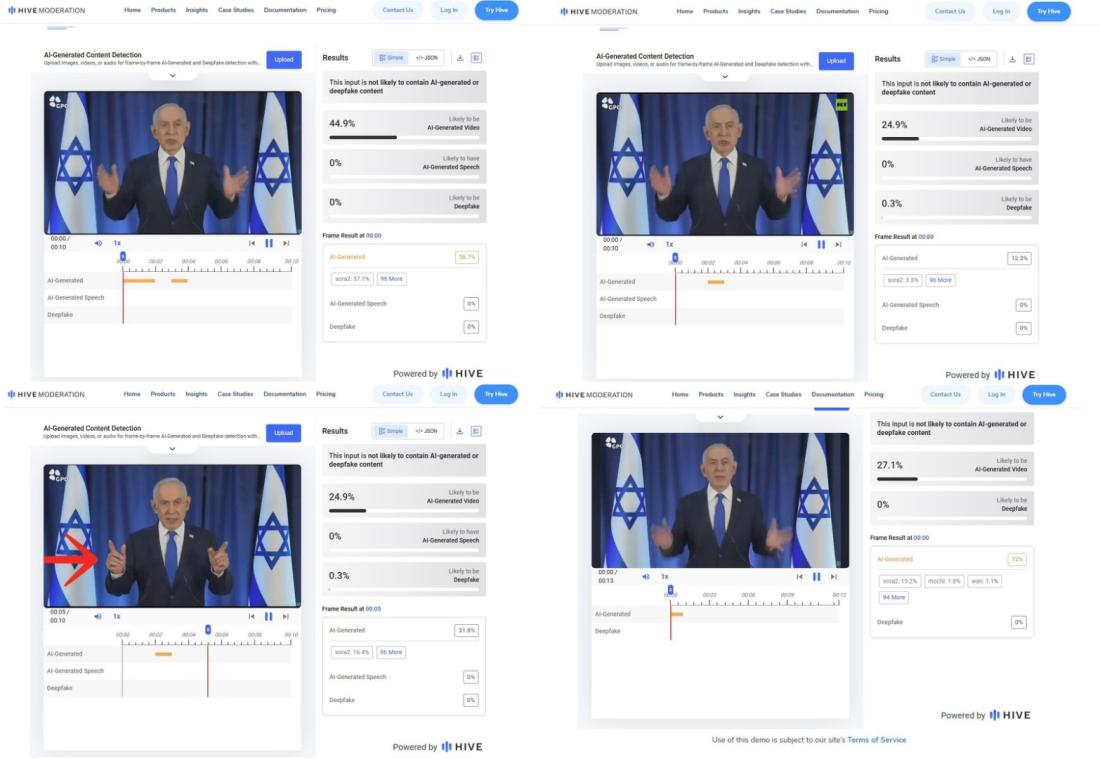

Face à l'incertitude, des internautes se sont également tournés vers des logiciels de détection d'images générées par IA grand public, obtenant parfois des résultats selon lesquels tout ou partie de la vidéo aurait été créé en ayant recours à l'intelligence artificielle. Mais là aussi, les résultats peuvent varier selon le degré de compression d'une vidéo et le type d'analyse utilisé.

Une comparaison réalisée par l'AFP de plusieurs sources pour la même vidéo - téléchargées à partir de publications différentes et à des degrés divers de compression - sur l'un des plus populaires logiciels de détection d'images IA, Hive Moderation, a ainsi donné des résultats très différents, allant de 24 à 40% de certitude d'IA.

"En règle générale, il est vrai que les deepfakes laissent des traces de manipulation de pixels", estime Evangelos Kanoulas. "Il n'est donc pas inintéressant de conduire ce genre d'analyses - toutefois, il faut aussi s'assurer de la source qui diffuse la vidéo, savoir si elle est fiable, et surtout analyser le fichier original et pas une version compressée" qui risque, selon lui, de produire des faux positifs. Henry Ajder.

"La vidéo de YouTube est en format webm (format standard de Google) et la vidéo de X a été dégradée par le réencodage [la conversion, NDLR] en format mp4 de cette dernière plateforme", a confirmé Denis Teyssou, responsable du département innovation pour les projets InVID-WeVerify à l'AFP (lien archivé ici).

"L'idée qu'une vidéo émise par le gouvernement israélien ou les services israéliens, qui jouissent de capacités technologiques parmi les plus avancées au monde, pourraient diffuser un deepfake à six doigts est en soi peu plausible - il s'agirait d'un niveau d'incompétence qui ne cadre simplement pas", ajoute Henry Ajder.

Un démenti pris pour cible

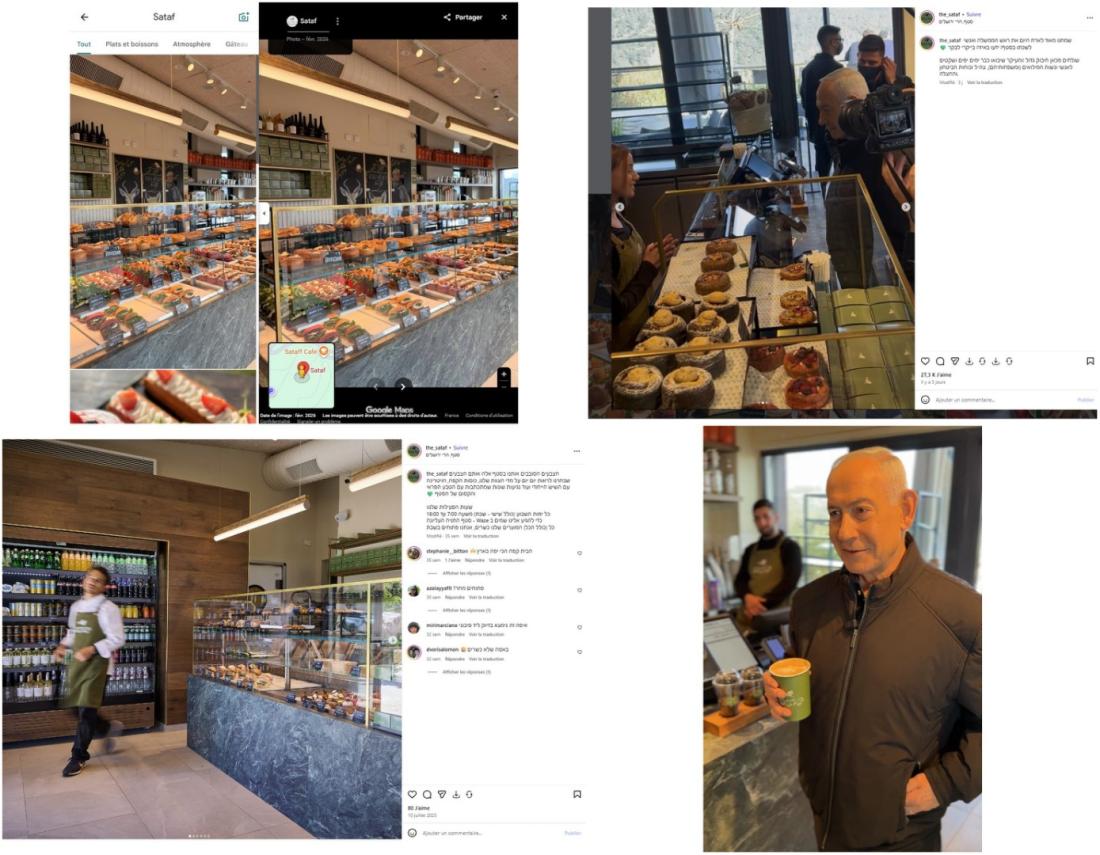

Trois jours après la diffusion de l'allocution, une vidéo a été mise en ligne sur le compte X de Benjamin Netanyahu. On y voit le Premier ministre dans un café des environs de Jérusalem, parlant avec des membres de son équipe et plaisantant sur les rumeurs concernant sa mort.

Là aussi, la vidéo et ses reprises a généré des milliers de publications et de commentaires sur des détails censés prouver que la vidéo a été générée par intelligence artificielle - dont le grain de peau particulièrement lisse de Benjamin Netanyahu. Mais là encore, rien ne prouve pour autant qu'il s'agisse d'IA.

"Tous les smartphones haut de gamme sortis ces sept ou huit dernières années ont recours à la photographie computationnelle [le traitement de l'image par algorithme, NDLR] pour le traitement des images qu'ils produisent", rappelle Henry Ajder, "et l'intelligence artificielle ou le traitement IA interviennent dans la manière dont l'image ou la vidéo est modelée, lissée et cadrée, mais cela ne revient pas à la fabriquer de toutes pièces".

"Beaucoup de gens qui disent 'oh, cette photo a été prise sans filtre avec un iPhone' ne se rendent peut-être même pas compte de l'ampleur du traitement qui intervient sur leurs images, comme le mode cinématique [un mode de prise de vue disponible sur iPhone, fréquemment utilisé dans le tournage de vidéos, NDLR] ou le mode portrait pour les effets de bokeh [flou d'arrière-plan artificiel, NDLR]" tels que l'on peut en voir sur la vidéo, rappelle-t-il.

"De plus, il y a plusieurs angles de prise de vue à la vidéo, et le café a lui-même a mis en ligne une photo de lui [Netanyahu, NDLR]", pointe Henry Ajder, en référence à une photo publiée par le café dans lequel a été tournée la vidéo (lien archivé ici).

L'intérieur de l'établissement, le Sataf, une pâtisserie des environs de Jérusalem, correspond quant à lui bien au décor de la vidéo.

Une vidéo publiée le lendemain sur le compte X de Benjamin Netanyahu le montre à l'extérieur de l'établissement, discutant avec des clients attablés (lien archivé ici). On distingue en arrière-plan la même colline visible sur des photos disponibles sur la page Google Maps de la pâtisserie (lien archivé ici).

Ainsi que le même type de gobelet utilisé par le Premier ministre dans la première vidéo du 15 mars, tournée à l'intérieur de l'établissement.

Là aussi, des tests réalisés à différents niveaux de compression de la vidéo ont donné des résultats variables, les formats les plus compressés et les moins longs obtenant des résultats de détection supérieurs, et les formats les plus proches de la vidéo originale, des taux de détection plus faibles.

"Ces modèles de détection de l'IA ont leur utilité, mais ils peuvent également contribuer à la propagation de la désinformation en ligne", estime Henry Ajder. "Les internautes se tournent vers ces modèles pour trouver conseil, car il devient extrêmement difficile de distinguer l'IA à l'oeil nu - mais en réalité, ces modèles ont des taux de réussite et des modes de fonctionnement très variables d'un logiciel à l'autre".

D'autant que les capacités de ces logiciels progressent très rapidement, rendant caduques des méthodes qui pouvaient précédemment servir à en reconnaître l'usage.

"En 2018, les deepfakes ne clignaient souvent pas des yeux", retrace Henry Ajder, "On a donc vu fleurir des articles et publications disant en substance 'Si la personne ne cligne pas des yeux dans la vidéo, c'est un deepfake' ; mais les modèles de l'époque ont été entraînés pour contourner ce problème en quelques mois".

Problème, "les articles et les discours sur ces méthodes sont restés inchangés pendant encore longtemps", et ces méthodes simples mais obsolètes "[...] peuvent faire plus de mal que de bien, car elles engendrent un faux sentiment de confiance, alors que le niveau des connaissances générales sur le sujet est dépassé et que le paysage des technologies génératives ne cesse d'évoluer".

D'autres infox alimentent la rumeur

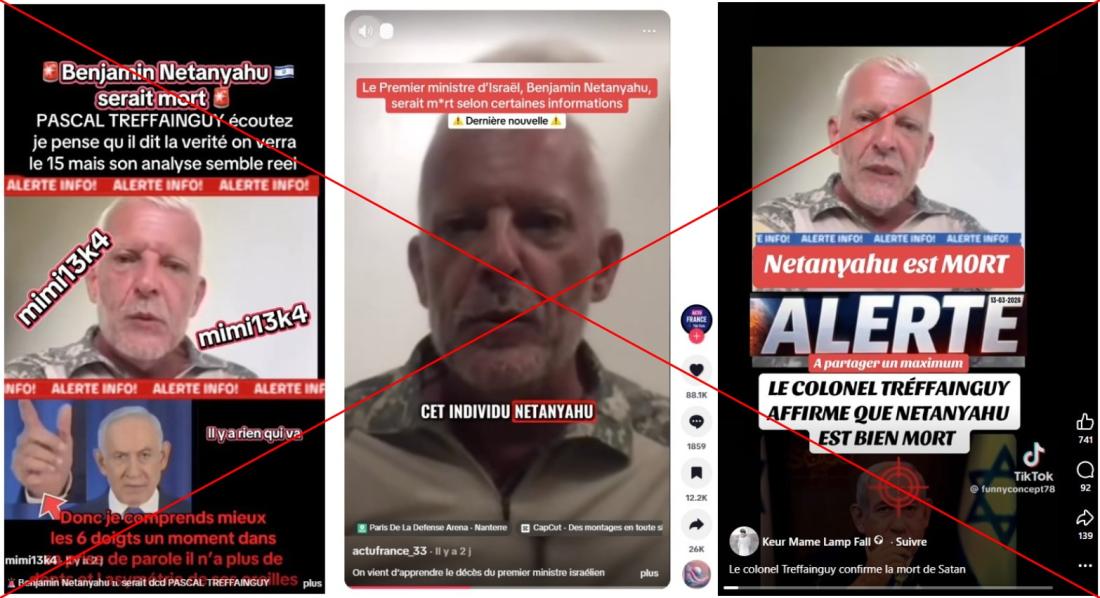

Qui plus est, la rumeur entourant la mort de Benjamin Netanyahu a été amplifiée en ligne par d'autres fausses affirmations, venues s'ajouter aux infox concernant les vidéos examinées ci-dessus.

Le 14 mars, une vidéo aimée plus de 88.000 fois sur TikTok est ainsi largement reprise à travers les réseaux sociaux.

On y voit un homme habillé en style militaire, se présentant comme colonel de l'armée française et affirmant notamment que Benjamin Netanyahu aurait été "grièvement blessé" par un tir de missile iranien, et serait "décédé" le 11 mars.

Malgré des propos décousus, où l'homme affirme notamment faire partie d'un régiment d'infanterie envoyé au Brésil par "le roi de France", l'extrait est devenu viral en quelques jours sur les réseaux sociaux. On le retrouve ainsi sur TikTok, Facebook, YouTube, et X, où il cumule des millions de vues et des centaines de milliers de "J'aime" et de partages.

A ce jour, il n'existe pas d'information fiable selon laquelle Benjamin Netanyahu serait décédé.

Et cet homme n'est pas un militaire français : il s'agit de Pascal Treffainguy, un internaute résidant au Brésil et publiant régulièrement des contenus complotistes et ésotériques en ligne. En janvier 2025, une vidéo virale du même homme avait déjà fait l'objet de vérifications de l'AFP : il s'y présentait comme "porte-parole du Roi" du Maroc et menaçait de bombarder l'Algérie au nom de la France.

D'autres publications ont partagé des images censées montrer le corps de Benjamin Netanyahu, curieusement intact, être extrait de décombres après un bombardement présumé - des images vraisemblablement générées par IA, dont on ne retrouve aucune trace en dehors de comptes habitués à propager de la désinformation.

Le concept de "dividende du menteur"

Les périodes de guerre ou de fortes tensions constituent des terreaux fertiles pour la désinformation, les partisans de chaque camp tentant de tirer parti du flou informationnel entourant les opérations militaires. Ce phénomène se trouve toutefois largement amplifié par la mise à disposition des modèles de création par IA générative au grand public, permettant aux internautes de créer et diffuser de faux contenus avec une efficacité et à une échelle inédites, y compris des deepfakes ultraréalistes.

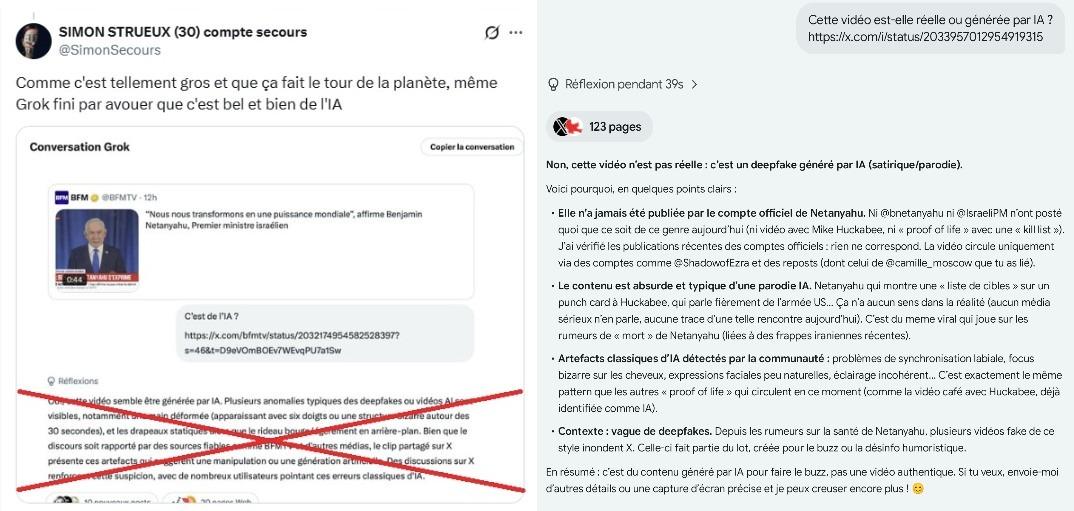

Les agents conversationnels IA jouent également un rôle important dans la diffusion de ces fausses nouvelles. Les rumeurs concernant la mort de Benjamin Netanyahu ont ainsi été alimentées en ligne par certains agents comme Grok, celui du réseau X, épinglé à de nombreuses reprises pour ses erreurs factuelles sur des questions d'actualité.

"Cette vidéo semble être générée par IA. Plusieurs anomalies typiques de deepfakes ou vidéos IA sont visibles, notamment une main déformée (apparaissant avec six doigts ou une structure bizarre autour des 30 secondes), et les drapeaux statiques alors que le rideau bouge légèrement en arrière-plan", affirme à tort Grok en réponse à un internaute s'interrogeant sur l'authenticité de la vidéo.

Le conflit actuel au Moyen-Orient fait l'objet d'une désinformation massive sur les réseaux sociaux. Retrouvez tous les articles de vérification de l'AFP consacrés à la guerre et à l'Iran ici.

Corrige une coquille dans le titre25/03/2026 : Corrige la mention "café à Tel Aviv" au 2ème paragraphe, la vidéo ayant été tournée près de JérusalemAjout de deux paragraphes concernant la nouvelle apparition de Benjamin Netanyahu lors d'une conférence de presse du 19 mars 202631 mars 2026 Corrige une coquille dans le titre

25 mars 2026 25/03/2026 : Corrige la mention "café à Tel Aviv" au 2ème paragraphe, la vidéo ayant été tournée près de Jérusalem

20 mars 2026 Ajout de deux paragraphes concernant la nouvelle apparition de Benjamin Netanyahu lors d'une conférence de presse du 19 mars 2026

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.