Après l'attentat de Sydney, les réseaux sociaux envahis par les fausses informations

- Publié le 16 décembre 2025 à 18:45

- Mis à jour le 23 décembre 2025 à 14:34

- Lecture : 15 min

- Par : Pierre MOUTOT, Cintia NABI CABRAL, Alexis ORSINI, AFP France

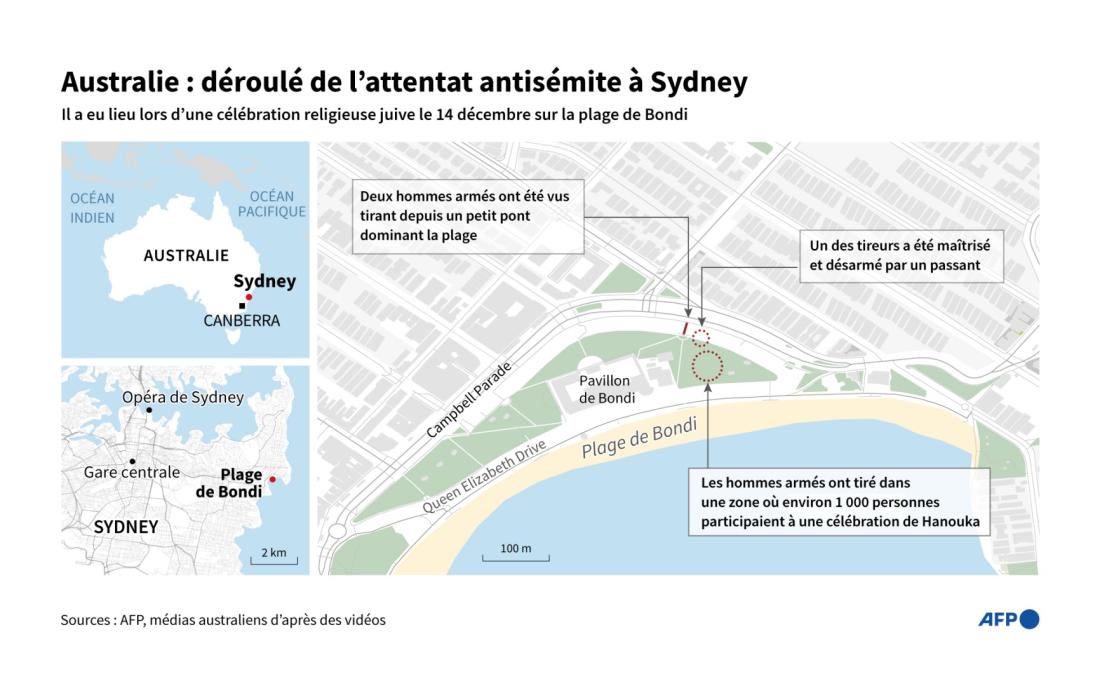

Le 14 décembre 2025, alors qu'une foule était rassemblée sur la plage de Bondi, à Sydney, pour célébrer la fête juive de Hanouka, un père et son fils ont ouvert le feu, tuant 15 personnes et en blessant 42 autres. Dans la foulée de ce attentat, qualifié "d'antisémite" et de "terroriste" par les autorités, la plus meurtrière fusillade connue par l'Australie depuis des décennies, de nombreuses fausses affirmations ou images trompeuses ont circulé sur les réseaux sociaux. L'AFP en a vérifié plusieurs.

Sajid et Naveed Akram, ont ouvert le feu à au moins 40 reprises, pendant une dizaine de minutes, sur une foule qui célébrait Hanouka sur la célèbre plage de Bondi, à Sydney, en Australie. Ils ont fait 15 morts et plus de 40 blessés (lien archivé ici).

L'attaque a été qualifiée d'acte "terroriste" par la police et les autorités australiennes dans la soirée de l'incident, et le lendemain, le Premier ministre Anthony Albanese a dénoncé de nouveau un "acte purement maléfique, antisémite et terroriste".

À la suite de la fusillade, plusieurs affirmations fausses et trompeuses ont massivement circulé sur les réseaux sociaux. L'AFP a pu vérifier certains de ces contenus.

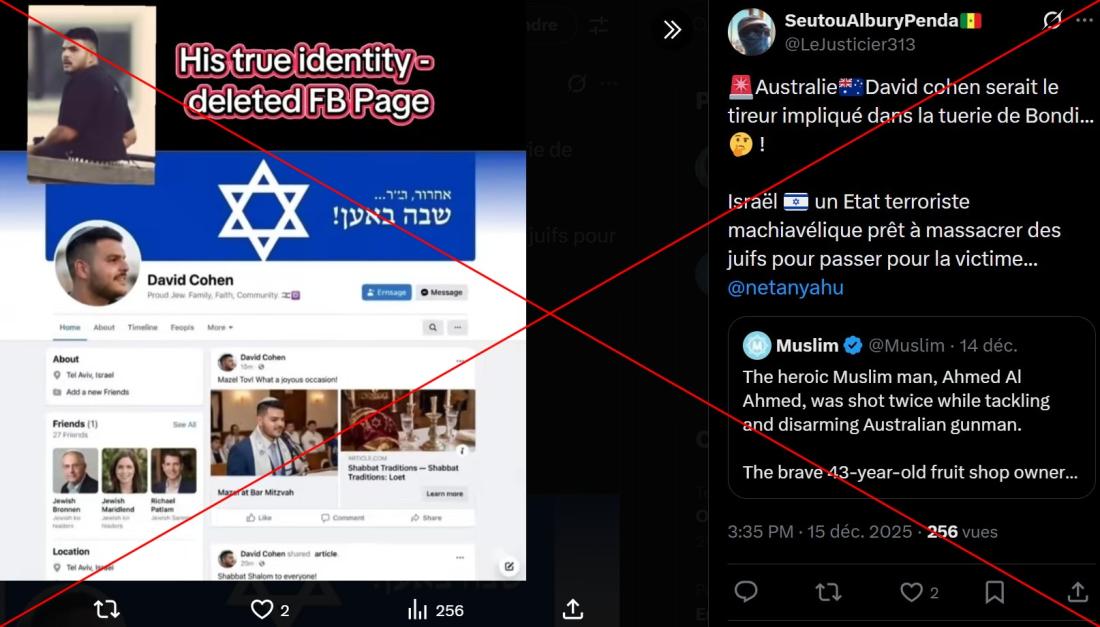

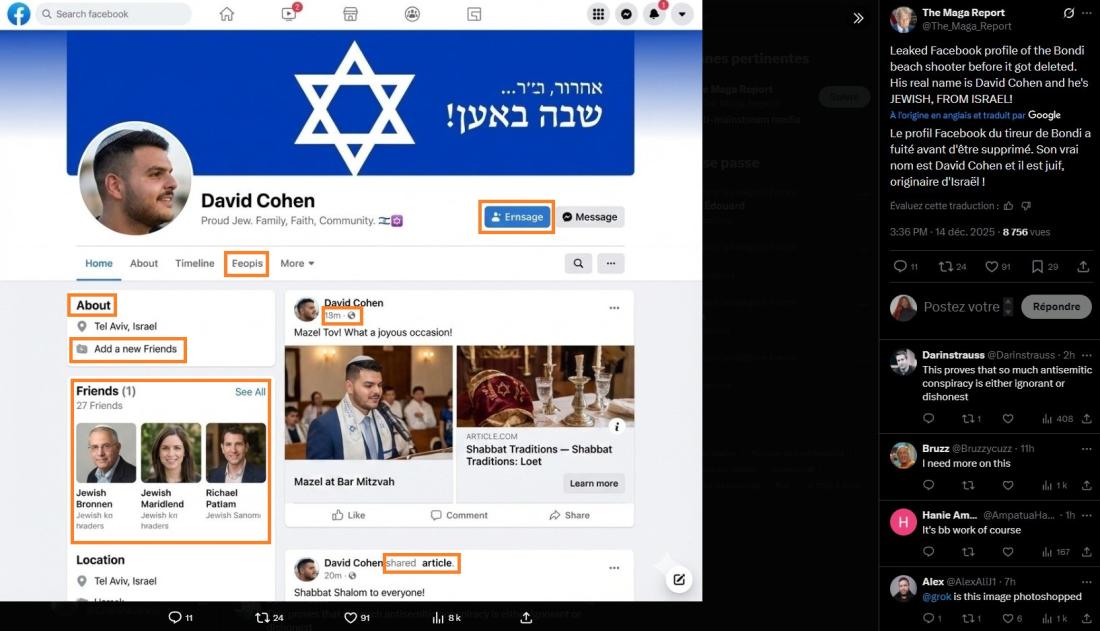

Un faux profil Facebook

"David Cohen serait le tireur impliqué dans la tuerie de Bondi... ! Israël un Etat terroriste machiavélique prêt à massacrer des juifs pour passer pour la victime", affirme un internaute sur X le 15 décembre.

Ces propos sont accompagnés d'une supposée capture d'écran d'un profil Facebook, appartenant à un certain "David Cohen". La photo de profil montre l'image de l'un des deux principaux suspects présumés, souriant et coiffé d'une kippa. La photo de couverture représente une étoile de David blanche sur fond bleu, accompagnée d'inscriptions en hébreu.

Des publications similaires circulent dans plusieurs langues, notamment en anglais (1, 2) et en turc.

Mais plusieurs éléments indiquent que ce profil n'existe pas, et qu'il a en réalité été généré à l'aide de l'intelligence artificielle (IA).

Une recherche par mots-clés en anglais a permis à l'AFP d'identifier ce qui semble être la première occurrence de cette image : une publication sur X datée du 14 décembre 2025, supprimée au moment de la publication de cet article.

"Le profil Facebook du tireur de Bondi a fuité avant d'être supprimé. Son vrai nom est David Cohen et il est juif, originaire d'Israël", lit-on, en anglais, dans la description de la photo.

Mais l'image présente de nombreuses incohérences. Plusieurs mots en anglais sont mal orthographiés, comme "Eopois" au lieu de "People" ("Personnes"), ou encore, "Ernsage" au lieu d"Engage" ("Interagir"). De plus, certains éléments de l'interface sont mal positionnés : la biographie apparaît à un emplacement inhabituel, et le bouton "Ajouter en ami" ("Add a new friends [sic]"), normalement situé en haut à droite et de couleur bleue, est n'est pas à la place habituelle.

Par ailleurs, les photos de profil du prétendu "David Cohen" et de ses supposés amis présentent des caractéristiques d'images générées par IA. Leurs noms - dont certains commencent par le mot "Jewish" ("juif" en anglais) - sont introuvables sur le réseau social.

Enfin, l'AFP n'a identifié aucun profil Facebook correspondant à cette description. Aucune archive en ligne ne permet non plus d'attester de l'existence de ce compte, renforçant l'hypothèse d'un faux profil fabriqué de toutes pièces.

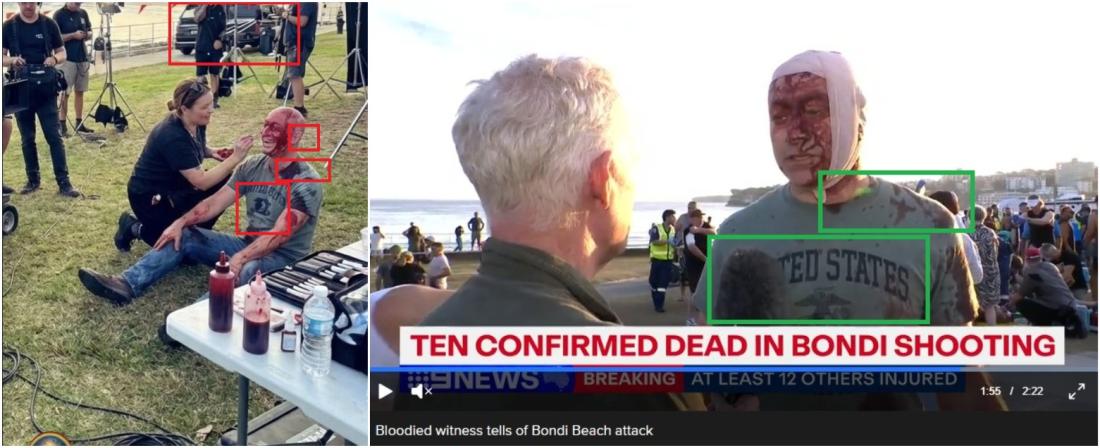

La prétendue photo d'une "fausse victime" en pleine séance de maquillage

"Tout était faux. Il s'agissait d'acteurs", soutient un internaute anglophone en légende d'une photo, vue plus d'un million de fois sur X depuis le 15 décembre.

L'image - également partagée par des internautes francophones - est censée montrer l'un des blessés de l'attaque de Bondi, Arsen Ostrovsky, avocat spécialisé dans les droits de l'homme, qui préside le Conseil australien/israélien des affaires juives à Sydney (AIJAC) tout sourire, en train d'être maquillé de faux sang pour jouer le rôle d'une victime (lien archivé ici).

Plusieurs internautes l'accusent ainsi d'avoir participé à une mise en scène, notamment parce qu'ils jugent "suspicieuse" sa photo en selfie, prise après qu'une balle a effleuré sa tête sur la plage de Bondi (attention, photo sanglante) et en raison de son engagement public pour Israël, en tant que membre du think tank Misgav Institute for National Security and Zionist Strategy.

Mais cette image n'a rien d'authentique : elle a été générée par IA, comme l'a notamment vérifié NewsGuard (lien archivé ici), une organisation qui analyse la fiabilité des sites et contenus en ligne, grâce au système de détection SynthID, qui permet de reconnaître une image générée par les outils d'IA de Google - en l'occurrence par le générateur Nano Banana Pro.

Plusieurs incohérences visuelles permettent en outre de le constater, comme la forme étrange de l'oreille du prétendu acteur, ou, en arrière-plan, sur une version plus large de l'image partagée sur Reddit, deux voitures qui se fondent en une.

De plus, les visuels que l'on distingue sur son t-shirt ne correspondent pas à ceux imprimés sur celui porté par Arsen Ostrovsky lors de son interview avec le média australien 9News - comme on peut le voir sur le comparatif visuel ci-dessous - au cours de laquelle il racontait le "chaos ambiant" lors de l'attaque (lien archivé ici).

L'inscription "United States" et un logo à l'effigie d'un aigle y sont ici bien visibles, alors que l'image générée par IA montre un texte et une image indéchiffrables. De plus, les taches de sang massives y imprégnant son t-shirt ne correspondent pas à celles, plus petites, que l'on peut observer dans la vidéo de 9 News.

Interrogé par le Daily Telegraph à propos de la fausse image générée par IA usurpant ses traits, Arsen Ostrovsky a indiqué ne pas vouloir "s'abaisser à répondre à cette campagne", indiquant seulement avoir découvert l'image factice juste avant son opération à l'hôpital (lien archivé ici).

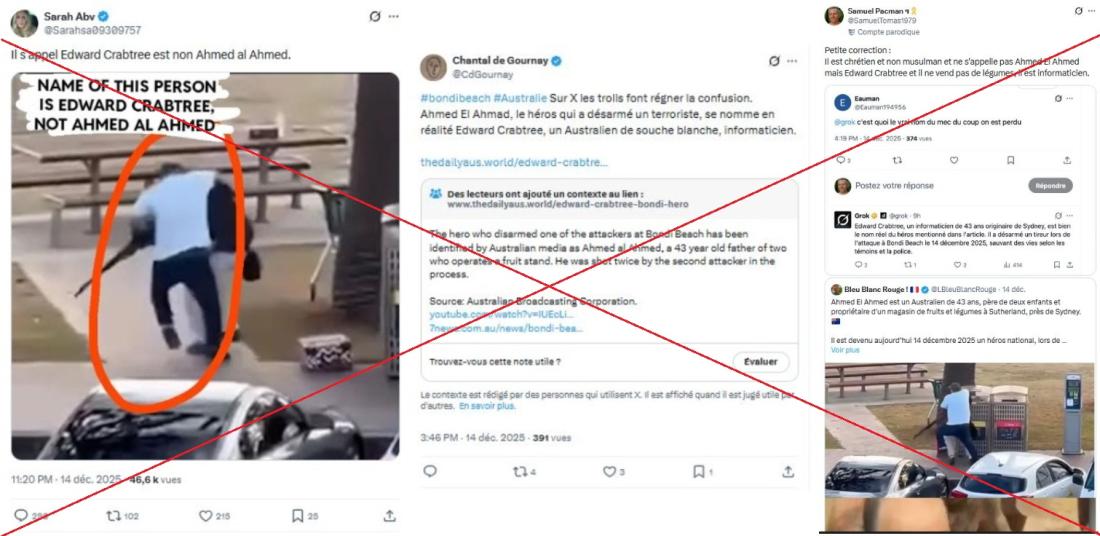

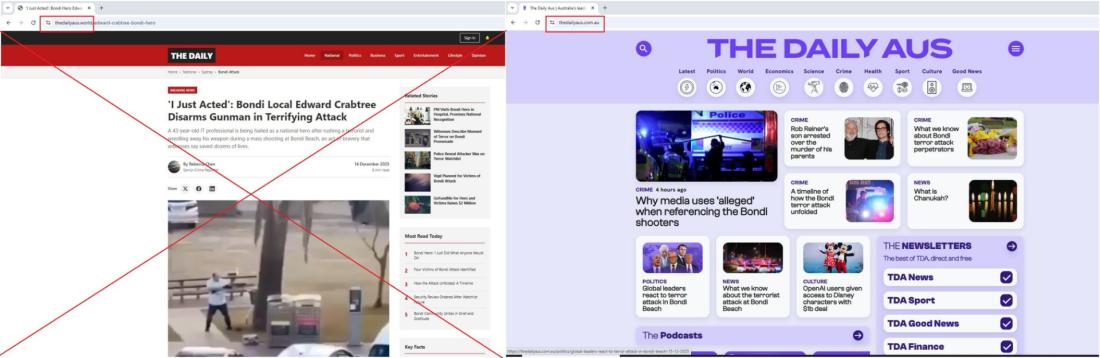

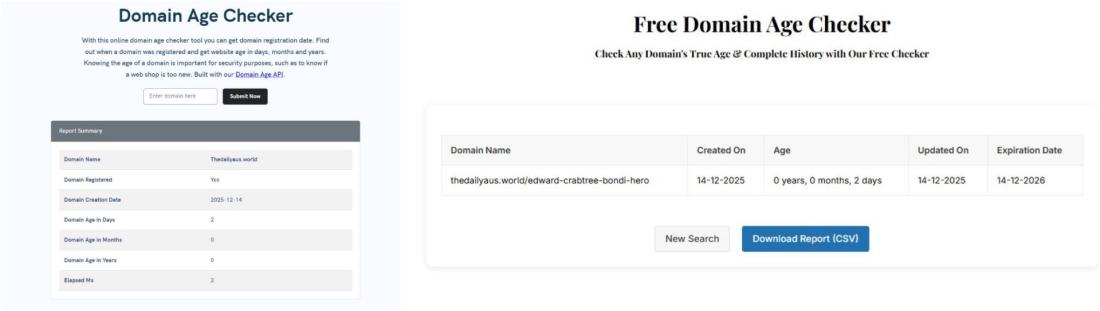

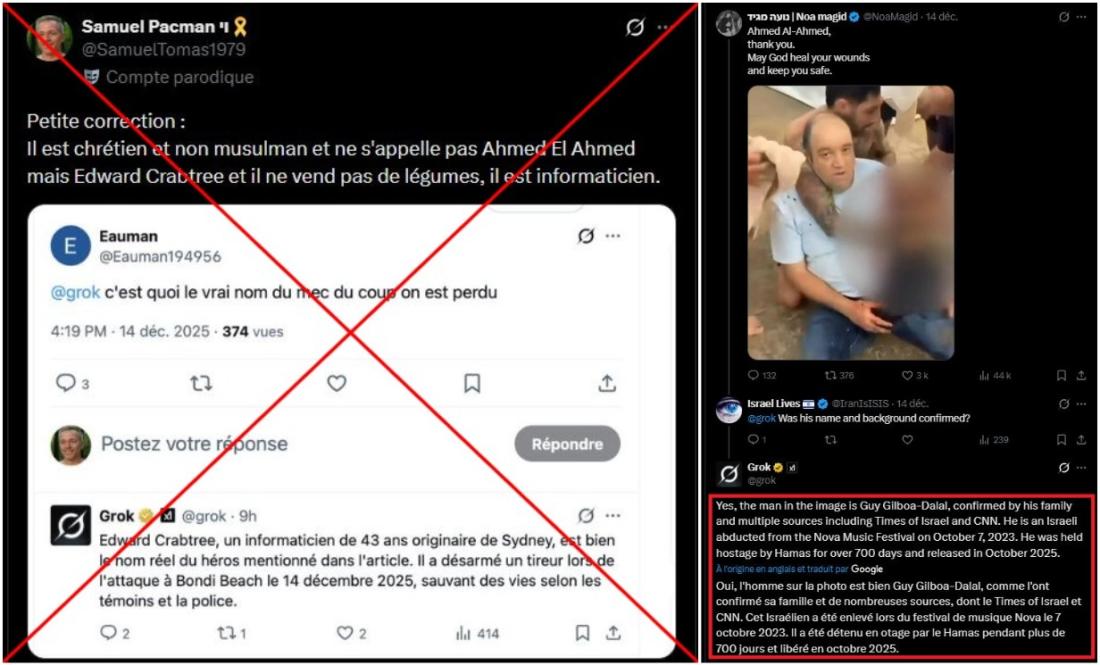

Un faux site d'actualité à l'origine d'une infox sur l'identité du "héros" de Bondi beach

Le jour même de l'attentat, un article publié sur un site web usurpant l'identité du journal australien The Daily Aus, créé pour l'occasion, prétendait ainsi révéler l'identité d'un homme, salué comme un "héros" pour s'être opposé aux assaillants (liens archivés ici et ici).

Mais le nom, la profession et jusqu'au déroulé des faits rapporté par l'article étaient faux et vraisemblablement générés par IA. Les reprises de l'infox sur les réseaux sociaux ont généré des millions de vues et de partages, dont des milliers en français.

À l'origine de cette fausse information, un site web prétendant avoir obtenu une interview de l'homme en question depuis son lit d'hôpital, blessé par balle après avoir maîtrisé l'un des attaquants et l'avoir désarmé. Selon le site en question, l'homme s'appellerait "Edward Crabtree", aurait 43 ans et serait informaticien de profession. Le faux article, dont le récit du déroulé de l'attaque est contraire aux faits établis à ce jour, donne une biographie inventée du personnage qui semble avoir été intégralement généré par intelligence artificielle.

Mais un examen du site web, dont l'unique article a été massivement partagé en ligne par des comptes sur les réseaux établis hors d'Australie, révèle des éléments suspects : le site reprend notamment le nom de domaine du média en ligne australien The Daily Aus en modifiant son adresse : "thedailyaus.world", contre l'authentique "thedailyaus.com.au". Il s'agit d'une technique récurrente visant à usurper l'identité d'un véritable média pour crédibiliser une fausse information, à des fins de propagande ou d'engagement.

Le faux site semble surtout avoir été créé pour l'occasion, et n'avoir aucune existence propre en dehors de l'article.

D'une part, aucun des liens ou rubrique sur le site internet ne fonctionne. D'autre part, une recherche sur des outils permettant de vérifier la date d'enregistrement d'un nom de domaine révèle qu'il l'a été le 14 décembre, vraisemblablement dans l'unique but de créer un site pour générer de la visibilité en profitant de l'activité médiatique autour de l'attaque.

Le média local 7News a en réalité identifié l'homme, dont le geste héroïque a fait le tour de la planète, sous le nom d'Ahmed el Ahmed, 43 ans, vendeur de fruits originaire de Syrie, et a indiqué qu'il avait été blessé par balle à deux reprises (lien archivé ici). Son identité a depuis été confirmée par des sources officielles australiennes (lien archivé ici).

Ce faux site d'actualité ne sera pas le seul à relayer des infox sur l'identité du "héros" de Bondi beach.

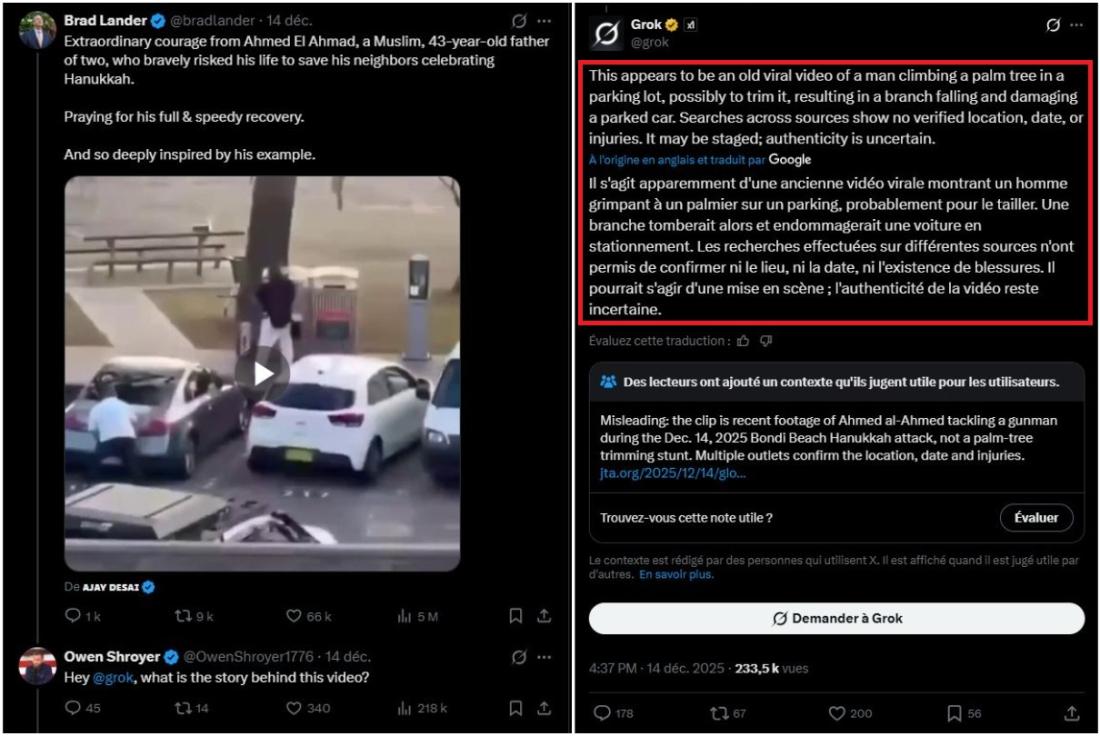

Des infox relayées par Grok

"L'homme sur la photo est bien Guy Gilboa-Dalal, comme l'ont confirmé sa famille et de nombreuses sources, dont le Times of Israel et CNN. Cet Israélien a été enlevé lors du festival de musique Nova le 7 octobre 2023. Il a été détenu en otage par le Hamas pendant plus de 700 jours et libéré en octobre 2025", affirme à tort le chatbot de X propulsé par IA Grok, le 14 décembre, en réponse à un internaute sur X qui s'interrogeait sur l'identité et l'origine de l'homme figurant sur cette photo.

Sous une autre publication, l'agent conversationnel affirme, comme l'a fait le faux article mentionné auparavant, que l'homme en question est "Edward Crabtree".

Le même jour, l'IA fournit une autre explication tout aussi erronée à un autre internaute : "Il s'agit apparemment d'une ancienne vidéo virale montrant un homme grimpant à un palmier sur un parking, probablement pour le tailler. Une branche tomberait alors et endommagerait une voiture en stationnement. Les recherches effectuées sur différentes sources n'ont permis de confirmer ni le lieu, ni la date, ni l'existence de blessures. Il pourrait s'agir d'une mise en scène ; l'authenticité de la vidéo reste incertaine".

Toutefois, ces réponses sont infondées : la vidéo et l'image de l'homme portant un haut blanc sont authentiques : il s'agit bien d'Ahmed el Ahmed, un Syrien, père de deux filles. Originaire de Neirab, dans le nord-ouest de la Syrie, il a quitté son pays en 2007 pour s'installer en Australie. Il y a travaillé dans le bâtiment avant d'ouvrir un magasin de fruits et légumes.

Ce n'est pas la première fois que cet agent conversationnel commet des erreurs. Il l'a déjà fait, notamment sur des sujets sensibles, comme le conflit Inde-Pakistan, ou encore sur les manifestations anti-immigration aux Etats-Unis (lien archivé ici).

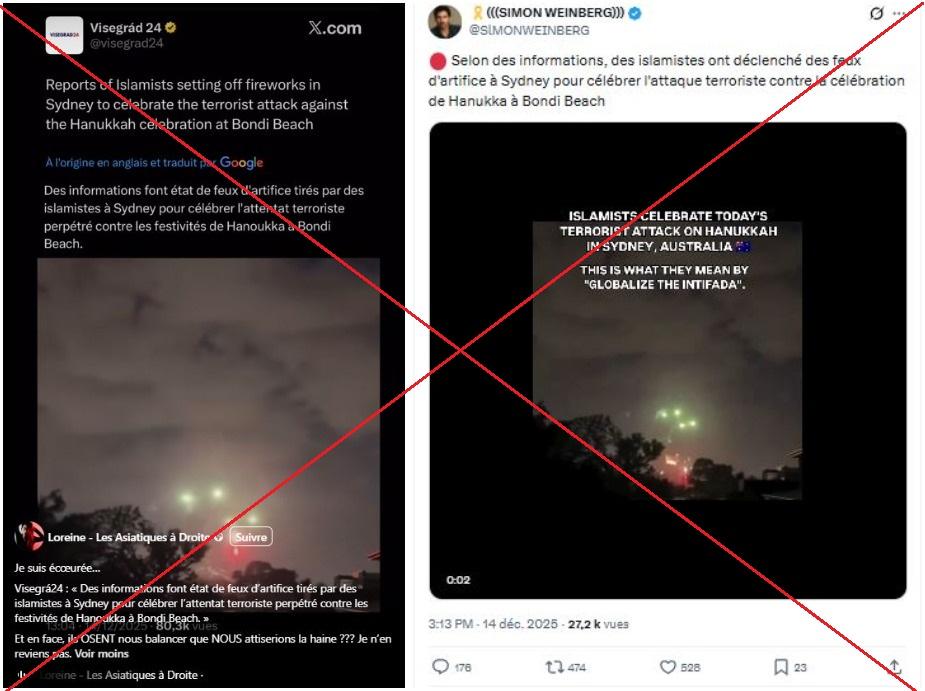

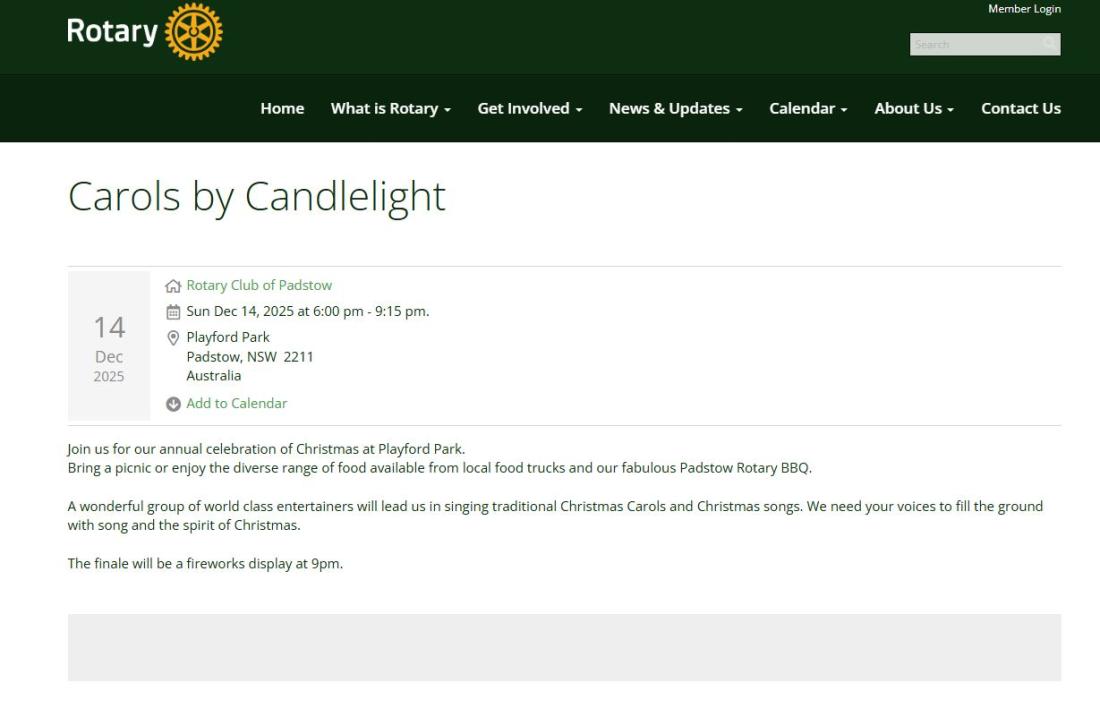

Des feux d'artifices de Noël, et pas des "célébrations" de l'attentat par des "islamistes"

Dans la soirée suivant la fusillade, des internautes ont partagé des vidéos de feux d'artifices dans la banlieue de Sydney, prétendant qu'elles montreraient des "islamistes" célébrer l'attaque mortelle.

"Selon des informations, des islamistes ont déclenché des feux d'artifice à Sydney pour célébrer l'attaque terroriste contre la célébration de Hanukka à Bondi Beach", affirme un internaute dans une publication partagée près de 500 fois sur X. L'infox, d'abord partagée en anglais, a ensuite été reprise sur les réseaux en plusieurs langues (lien archivé ici). On la retrouve notamment en français sur X et sur Facebook.

Mais ces images sont sorties de leur contexte et n'ont rien à voir avec la fusillade. Une recherche par mots-clés permet de retrouver trace de l'événement, qui s'est déroulé le dimanche 14 : il s'agit de réjouissances de Noël organisées par le Rotary Club de Padstow, une banlieue des environs de Sydney (liens archivés ici et ici).

Contactée par mail le 15 décembre, l'association a démenti tout lien entre son événement et de prétendues "célébrations" de l'attentat par des "islamistes" : "Les feux d'artifice faisaient partie de notre événement annuel de chants de Noël. Cet événement et le feu d'artifice avaient été planifiés plusieurs mois à l'avance, ils n'avaient aucun lien avec l'attentat terroriste de Bondi", a répondu le Rotary Club.

Un porte-parole de la municipalité de la municipalité de Padstow a indiqué le 16 décembre à l'AFP que les services de la ville n'avaient eu "aucune connaissance d'un autre événement impliquant des feux d'artifices dans notre ville" ce soir là, et condamné les publications virales, "[...] de la désinformation, inutile et blessante".

Ces vidéo de prétendues "célébrations de l'attentat" sont anciennes et n'ont rien à voir avec l'attaque

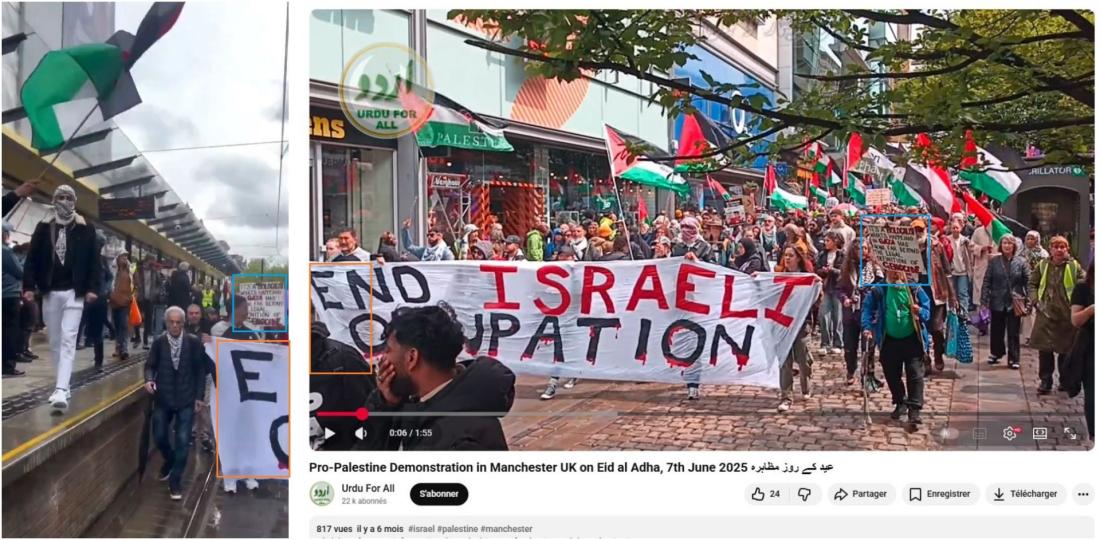

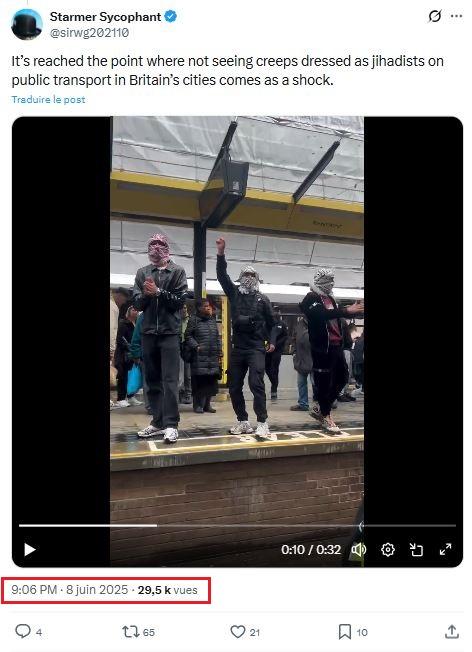

Dans le même esprit, des publications relayent une vidéo, dont elles prétendent qu'elle montre des "pro palestiniens [qui] fêtent les attentats antisémites perpétrés en Australie". On y voit des hommes, pour certains revêtus de keffiehs chanter et danser au cours d'une manifestation. Là aussi, la publication a d'abord été diffusée en anglais.

Des internautes ont également affirmé que des "célébrations" de l'attentat avaient eu lieu "partout dans le pays" en Australie.

Elles ont ensuite été reprises en français sur X, où l'infox compte plus de 800 partages, et Facebook, dans des publications affirmant que les manifestations avaient eu lieu en Angleterre et que d'autres auraient eu lieu "en France".

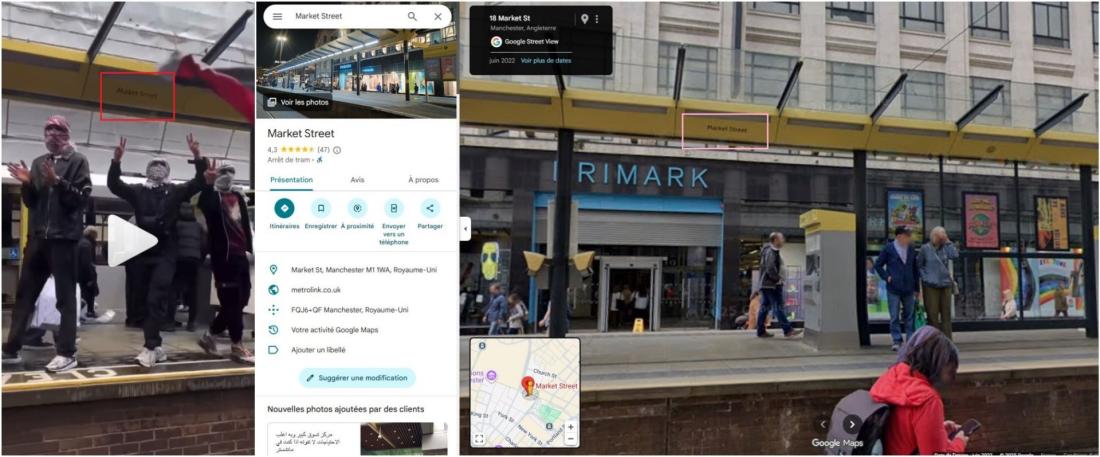

Mais ces images, qui montrent une petite manifestation en faveur de la Palestine en Angleterre, n'ont pas été tournées en Australie et datent de début juin 2025, sans aucun lien avec l'attentat perpétré le 14 décembre.

Une recherche d'images inversée permet de localiser le lieu de la manifestation : on y distingue l'arrêt de tramway Market Street, situé à Manchester, au Royaume-Uni (lien archivé ici).

D'autres éléments visuels permettent de retrouver une vidéo de la manifestation en question : celle-ci a eu lieu le 7 juin 2025, selon l'auteur de la vidéo et la date de mise en ligne sur YouTube, soit sept mois avant l'attentat de Sydney.

En effectuant une recherche avancée par mots-clés et par date sur X, on retrouve le même extrait vidéo que celui partagé sur la publication trompeuse, mis en ligne le 8 juin 2025, soit le lendemain de la manifestation.

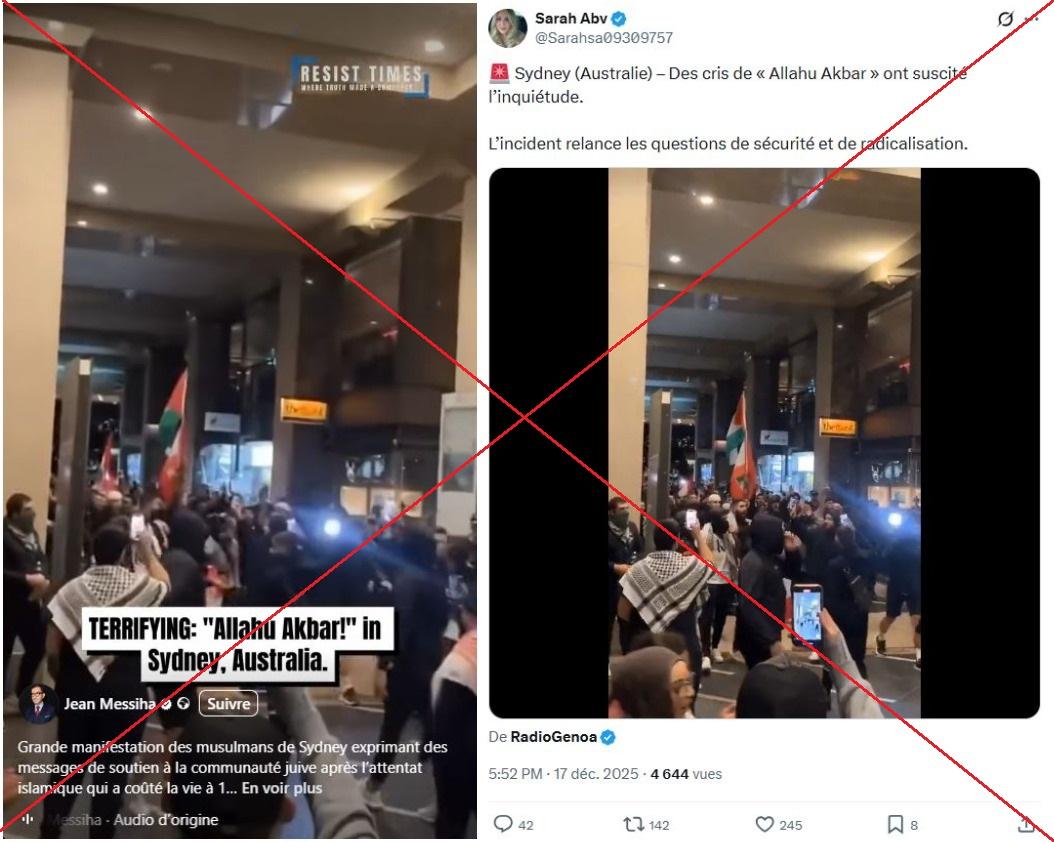

Plus d'une semaine après l'attaque, des vidéos de manifestations décontextualisées continuent de circuler les réseaux pour accuser "les musulmans" de Sydney de 'fêter' l'attentat : c'est par exemple le cas de cet extrait, diffusé en anglais puis en français, par des comptes partageant régulièrement de la désinformation.

Mais là aussi, c'est faux. Des recherches d'images inversées montrent que le clip vidéo est en ligne depuis octobre 2023, et est issu de la manifestation du 9 octobre 2023 à Sydney, qui avait réuni des milliers de personnes demandant la fin du soutien de l'Australie à Israël, selon l'Australian Associated Press.

Aucun rapport, donc, avec de quelconques "célébrations" de l'attentat de Sydney.

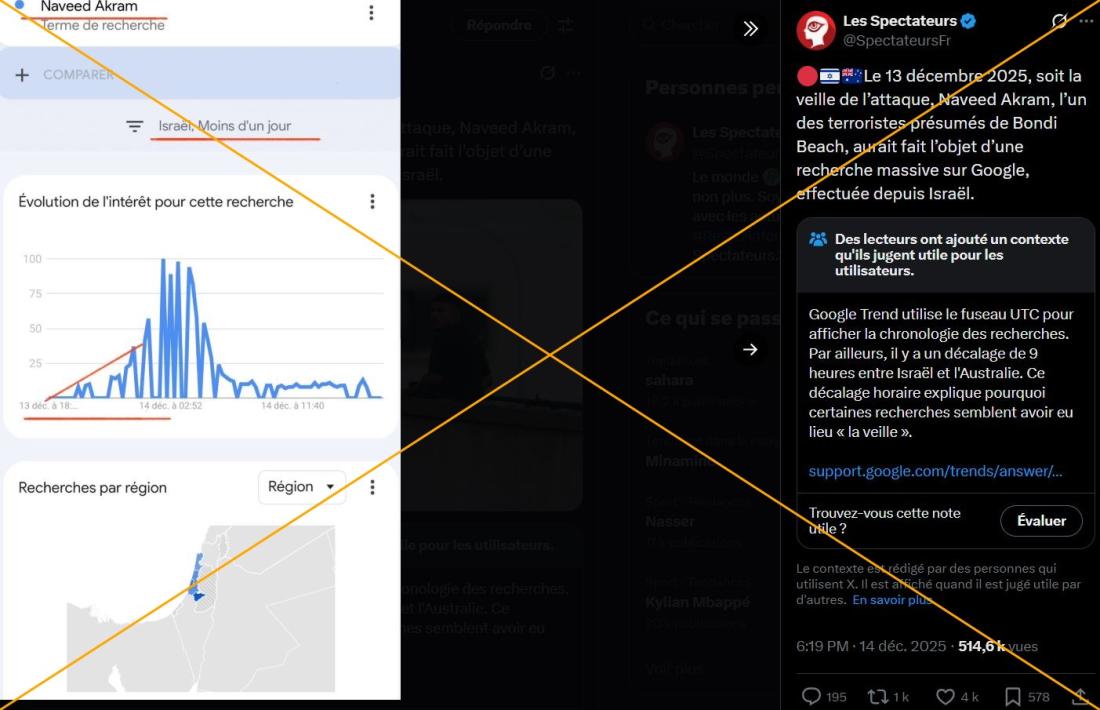

De prétendues recherches sur Google la veille de l'attentat

"Le 13 décembre 2025, soit la veille de l'attaque, Naveed Akram, l'un des terroristes présumés de Bondi Beach aurait fait l'objet d'une recherche massive sur Google, effectuée depuis Israël", affirme une publication diffusée sur X. Mise en ligne le 14 décembre, celle-ci a été relayée des milliers de fois et cumule plus de 514.000 vues.

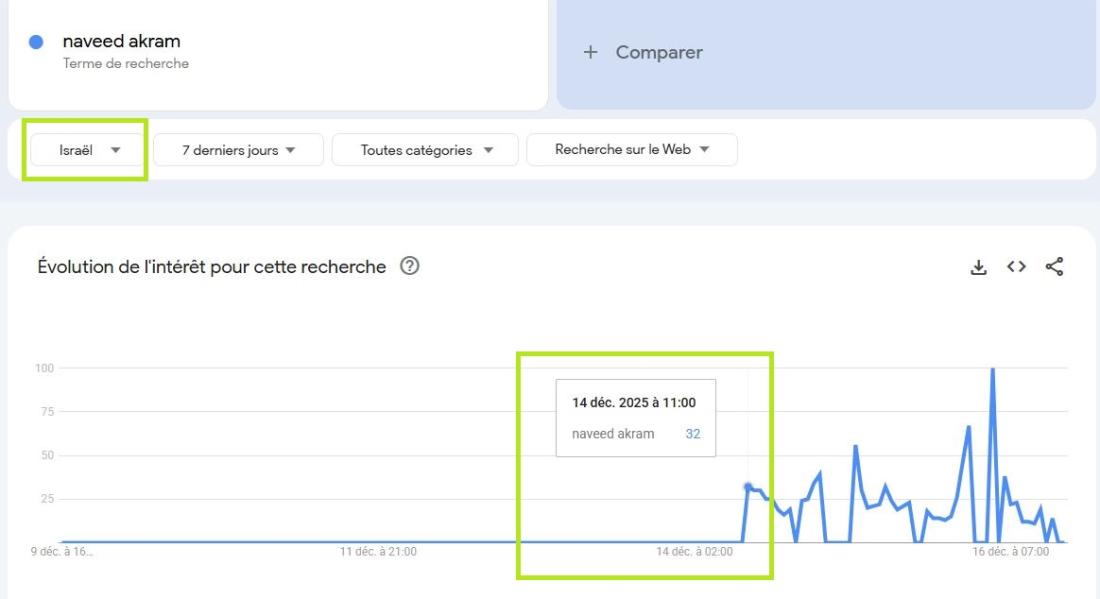

Pour étayer cette affirmation, la publication s'appuie sur une capture d'écran de l'outil statistique Google Trends, montrant un pic soudain des recherches en ligne du terme "Naveed Akram". Selon l'auteur, ce graphique indiquerait une activité de recherche exceptionnelle à cette période (lien archivé ici).

Des messages similaires circulent sur X, et dans plusieurs langues, notamment en anglais et en arabe.

Mais cette affirmation est trompeuse : il y a un décalage horaire de 9 heures entre Tel Aviv et Sydney, en Australie, ce qui a pu contribuer à la mauvaise interprétation de ces recherches chez certains internautes (lien archivé ici).

Selon cette reconstitution de l'AFP sur l'attentat antisémite de la plage de Bondi, la police précise avoir reçu les premiers appels d'urgence à 18 h 47 (06:47 PM) à Sydney, soit 9 h 47 (09:46 AM) à Tel-Aviv (lien archivé ici).

D'après les données visibles sur Google Trends, les recherches associées au nom de l'assaillant présumé, "Naveed Akram", atteignent un premier pic aux alentours de 11 heures à Tel-Aviv, en Israël, soit 1 heure et demie après l'attaque, et non la veille de l'attaque antisémite.

23 décembre 2025 23/12/2025 : Ajoute la vérification d'une vidéo décontextualisée de manifestation pro-Palestine, circulant toujours une semaine après l'attaque pour faire croire à des "musulmans " fêtant l'attentat

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.