La désinformation prorusse entre en scène sur le réseau social Bluesky

- Cet article date de plus d'un an.

- Publié le 13 janvier 2025 à 15:31

- Mis à jour le 14 janvier 2025 à 18:19

- Lecture : 6 min

- Par : Dounia MAHIEDDINE, Claire-Line NASS, AFP France

A partir de données récoltées depuis fin décembre par le collectif @antibot4navalny (ici sur X et là sur Bluesky), spécialisé dans la traque des opérations d'influence et à l'origine des révélations sur la présence et l'ampleur de "Matriochka" ("Poupée russe" en français) sur X, l'AFP a pu analyser des dizaines de publications présentant toutes les caractéristiques de cette opération, aussi appelée "Overload", sur le réseau social américain Bluesky (liens archivés ici et ici).

Le mode opératoire est toujours le même : interpeller des médias pour leur demander de vérifier ou commenter des infox et leur faire perdre leur temps. Avec une nouveauté : sur Bluesky, en plus d'imiter des publications de médias, des contenus trompeurs générés par intelligence artificielle usurpent aussi l'identité d'institutions universitaires.

Créé en juillet 2023, Bluesky est devenu fin 2024 un refuge pour les déçus de la plateforme X détenue par Elon Musk, annoncé comme futur membre du gouvernement du président américain Donald Trump. Fin décembre, Bluesky revendiquait près de 26 millions d'utilisateurs, dont près de la moitié arrivés dans la foulée de la présidentielle américaine (lien archivé ici).

Cette popularité croissante a semble-t-il attiré des acteurs de la désinformation en ligne. Le 19 décembre, Eliot Higgins, le fondateur de Bellingcat, collectif spécialisé dans les enquêtes en sources ouvertes, a mis en avant la présence de certains comptes sur Bluesky présentant toutes les caractéristiques des "bots" pro-russes, des profils inauthentiques utilisés pour augmenter artificiellement la visibilité de publications (lien archivé ici).

Depuis, l'AFP a pu, à partir de données récoltées par @antibot4navalny, détecter un peu plus d'une cinquantaine de publications présentant les caractéristiques de contenus liés à "Matriochka". Tous les messages repérés semblent aussi avoir été publiés sur X, d'après les analyses du collectif.

Il est ainsi possible, pour Valentin Châtelet, du laboratoire d'analyse numérique (DFC) de l'Atlantic Council, que "l'opération tente de tester son efficacité en termes de portée", dans le but de préparer d'autres offensives (lien archivé ici).

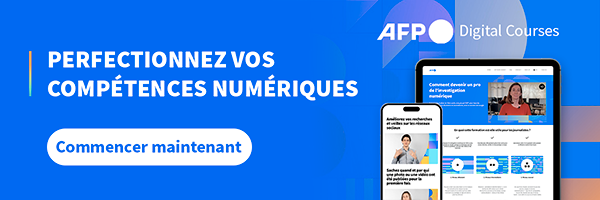

De nouveaux contenus sont publiés quasi-quotidiennement depuis décembre, et collent au plus près à l'actualité. Par exemple, le 10 janvier, une vidéo a été diffusée sur Bluesky accompagnée d'une légende en anglais : "Non, je ne peux pas le croire. C'est de la folie ! Quelqu'un peut-il m'expliquer cela ?". Le compte interpelle plusieurs médias sur Bluesky dont la BBC.

La vidéo utilise le logo de ce média britannique et montre d'abord une de ses journalistes évoquant l'annonce de la fin du programme de fact-checking de Meta aux Etats-Unis, annoncée par Mark Zuckerberg le 7 janvier (lien archivé ici). Des illustrations s'enchaînent ensuite, tandis qu'une voix off déclare, en anglais : "Plus de 100.000 faux rapports diffusés par l'Ukraine ont été découverts par des journalistes indépendants en décembre 2024. Et ce n'est que ce qu'ils ont pu trouver manuellement. Combien de désinformation ukrainienne est passée inaperçue ?".

La voix pointe ensuite du doigt Bluesky, citant prétendument deux experts pour assurer que le réseau social aurait abrité des "dizaines de millions" d'infox en décembre.

Cependant, cette vidéo également diffusée sur X a été manipulée : la vidéo originale, publiée sur les comptes TikTok et Instagram officiels de la BBC, ne fait aucune mention de l'Ukraine (liens archivés ici et ici).

Deepfakes universitaires

Plus généralement, les publications repérées sur Bluesky ont pour point commun de présenter la Russie très positivement, tout en critiquant l'aide occidentale apportée à l'Ukraine, avec une attention particulière aux politiques d'Emmanuel Macron, qui apparaît comme une cible privilégiée.

Mais, détail nouveau : en plus d'usurper l'identité de médias pour diffuser de faux reportages, ces publications se présentent désormais aussi comme émanant d'universités, qu'elles soient françaises ou internationales.

Le but semble être "d'asseoir des arguments d'autorité - parce que ces personnes qui apparaissent dans les vidéos sont des experts reconnus dans leur domaine, leurs paroles semblent avoir du cachet même dans des domaines qui n'ont rien à voir", analyse Peter Benzoni, spécialiste des manipulations de l'information de l'Alliance pour la sécurisation de la démocratie au sein du German Marshall Fund (GMF, lien archivé ici). "L'objectif général reste de trouver des points liés à l'actualité sociale qui peuvent appuyer des fractures et de les exploiter au profit de la Russie, en s'adaptant au public de Bluesky", selon lui.

Par exemple, dans une vidéo truquée, un professeur de l'université d'Aix-Marseille évoque des "nombreuses erreurs dans l'organisation des Jeux olympiques", assénant : l'"économie de la France aujourd'hui, c'est la Seine pendant les JO : impropre à la vie". En cause, selon la description de la publication : les "sanctions contre la Russie ont détruit l'économie française".

Mais c'est un deepfake, un contenu dont l'audio a été manipulé : l'AFP a retrouvé la vidéo originale publiée fin octobre sur le compte Instagram de l'université. Dans celle-ci, le professeur de droit ne mentionnait nullement l’économie française, mais il faisait le bilan de l'année 2024 dans son département universitaire.

Dans cette vidéo, comme dans des dizaines d'autres visionnées par l'AFP, la mise en scène est similaire : l’expert apparaît face caméra, accompagné du logo ou du nom de l’université. Puis, après quelques phrases, des images d’illustration s’enchaînent, dont l’AFP a pu retracer l’origine dans des médias ou des banques d’images en ligne.

Sur d'autres images, tournées sur le campus de l'université anglaise de Sunderland, on voit des étudiants et enseignants donner prétendument leur avis sur la Russie, lui attribuant une série d'adjectifs élogieux.

Là encore, c'est une manipulation : dans la vidéo d'origine que l'AFP a pu retrouver sur les réseaux sociaux de l'université, les personnes interrogées s'exprimaient à l'occasion de la journée internationale des droits des femmes, en expliquant ce que représentait être une femme pour elles, sans faire la moindre allusion à la Russie.

"Cela indique que la campagne a réussi à industrialiser sa fabrication de voix-off truquées, ce qui fait écho à une tendance commune à diverses opérations de désinformation provenant de la Russie, où les trucages, les articles générés par l'IA et les images, deviennent de plus en plus courants", analyse Valentin Châtelet.

L'expert fait notamment référence à des campagnes d'influence déjà mises au jour ces dernières années, comme "Doppelgänger", qui copie des sites de médias occidentaux, ou encore CopyCop, qui utilise de l'IA pour alimenter de faux sites.

Il rappelle aussi que si la technique des deepfakes audio "n'est pas nouvelle en soi, son utilisation dans le contexte de l'opération Matriochka représente un aspect inédit de la campagne".

Selon lui, "il est également très probable que la technologie de l'IA soit devenue plus populaire et moins chère", ce qui pourrait en multiplier l’usage dans ce type de campagnes à l'avenir.

Des efforts pour limiter la portée

Parmi la cinquantaine de publications recensées par @antibot4navalny au 6 janvier, près de la moitié visent directement la France, avec un focus particulier sur les politiques d'Emmanuel Macron. Quelques-unes ciblent les organisations de fact-checking, laissant entendre qu'elles seraient inefficaces.

La majorité d'entre elles avaient, en l'espace de quelques jours, été supprimées de la plateforme, a constaté l'AFP.

Le fonctionnement même de Bluesky, qui est un réseau social distribué - ou décentralisé -, implique que le contenu qui s'y trouve doit respecter des "règles de la communauté", qui reposent en grande partie sur le signalement des contenus problématiques par les utilisateurs de la plateforme (lien archivé ici).

"En pratique, la désinformation et les usurpations d'identité sont principalement contrées à travers des signalements via des 'étiquettes' apposées sur les contenus, et par du filtrage plutôt que par leur suppression", remarque Peter Benzoni.

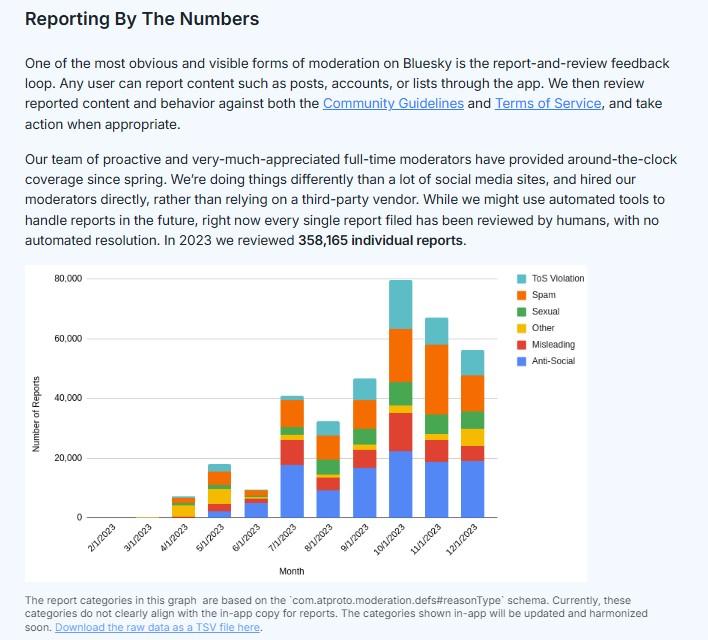

Plusieurs observateurs du déploiement de l'opération sur Bluesky, dont @antibot4navalny, ont par exemple recensé les comptes véhiculant de la désinformation, créant des listes de ces désinformateurs et encourageant les internautes à les signaler au réseau social (liens archivés ici et ici), qui revendique un engagement actif contre les infox. En 2023, son équipe de modérateurs affirme avoir traité plus de 358.000 signalements.

"Bluesky est conscient du problème et sait que la communauté des vérificateurs de faits et des chercheurs de sources ouvertes enquête déjà sur ce contenu et le signale afin d'empêcher sa viralité", résume Valentin Châtelet.

Des efforts jugés "plutôt efficaces pour limiter l'opération" à ce stade, selon l’expert, qui rappelle néanmoins que ces actions demeurent "très réactives" et que BlueSky doit encore prouver qu'il peut démanteler de manière "proactive" cette opération, qui continue de s'étendre.

Sollicité par l'AFP, le réseau social n'avait pas apporté de réponse au moment de publication de cet article.

Supprime mot en trop au 7ème paragraphe et met à jour la mention au 6ème paragraphe de publications "natives" sur Bluesky : le collectif a depuis pu retrouver chacun des posts sur X, publiés en même temps ou précédemment à ceux sur Bluesky14 janvier 2025 Supprime mot en trop au 7ème paragraphe et met à jour la mention au 6ème paragraphe de publications "natives" sur Bluesky : le collectif a depuis pu retrouver chacun des posts sur X, publiés en même temps ou précédemment à ceux sur Bluesky

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.