ChatGPT interdit en France en 2025 ? Attention à ces rumeurs infondées

- Cet article date de plus d'un an.

- Publié le 27 décembre 2024 à 10:49

- Lecture : 8 min

- Par : Lucie DE PERTHUIS, AFP France

Lancé en novembre 2022, ChatGPT est un outil d'intelligence artificielle (IA) générative développé par l'entreprise américaine OpenAI.

Sous la forme d'un chat (un programme qui permet de produire des conversations avec les usagers), il répond en temps réel aux questions des utilisateurs, peut effectuer des traductions, synthétiser des textes ou encore générer du code informatique.

Début décembre 2024, OpenAI disait comptabiliser 300 millions d'utilisateurs actifs de ChatGPT dans le monde chaque semaine (lien archivé ici).

En France, l'outil est aussi largement utilisé : selon une étude Ipsos publiée à la fin de l'année 2023, un an après son lancement, 65% des moins de 35 ans indiquaient l'avoir déjà utilisé, tout comme 67% des cadres. Plus d'un Français sur deux disait aussi connaître ChatGPT, et 83% en avaient entendu parler (lien archivé ici).

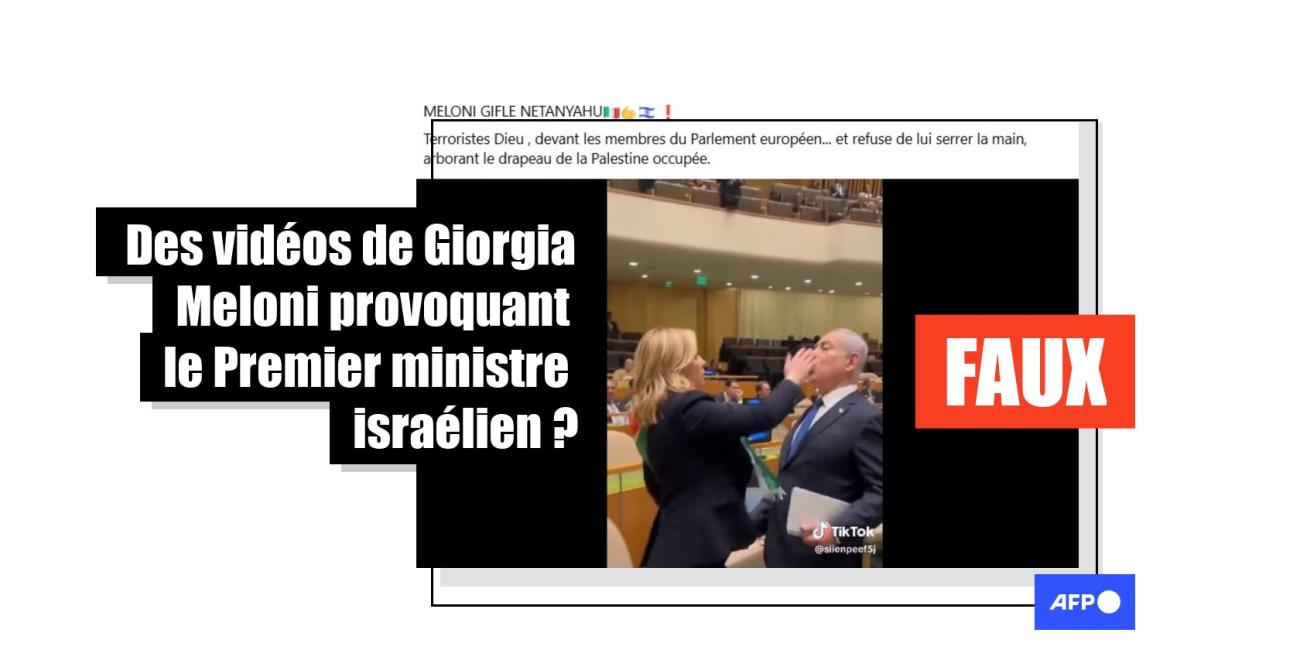

Depuis début décembre 2024, de nombreuses publications sur les réseaux sociaux assurent pourtant qu'"Emmanuel Macron" aurait annoncé interdire ChatGPT en France en 2025.

"C'est confirmé, ChatGPT sera supprimé à partir de 2025", prétend par exemple cet internaute dans une vidéo publiée sur Tiktok le 8 décembre 2024 partagée à plus de 13.000 reprises.

Une rumeur rapidement devenue virale chez des usagers du réseau social qui craignent de ne plus pouvoir compter sur l'outil : "Je vais faire comment pour les cours ? Pour rédiger mes devoirs ? (...) Moi, ma vie elle se base sur ChatGPT", s'inquiète par exemple cet étudiant.

"Depuis que je suis au lycée, je n'utilise que ChatGPT, qu'est-ce qu'on va faire maintenant ?", s'interroge cet autre utilisateur de Tiktok.

Mais ces rumeurs sont infondées.

OpenAI dit ne pas avoir connaissance d'une telle interdiction

L'AFP n'a trouvé aucune trace de déclaration d'Emmanuel Macron mentionnant une éventuelle suppression ou interdiction de ChatGPT en France à partir de 2025.

Contactée par l'AFP le 24 décembre 2024, l'entreprise mère de ChatGPT, OpenAI, indique ne pas avoir connaissance d'informations pouvant corroborer une telle affirmation.

L'entreprise vient par ailleurs d'ouvrir ses premiers bureaux à Paris au mois de novembre 2024.

Et contrairement à ce qu'affirment les publications sur les réseaux sociaux, Emmanuel Macron avait assuré se réjouir de l'arrivée en France de l'entreprise américaine, publiant sur X une capture d'écran de sa conversation avec ChatGPT dans laquelle il souhaite la bienvenue à ses créateurs à Paris (lien archivé ici).

Le patron d'OpenAI Sam Altman s'était de son côté dit "enthousiaste" à l'idée de "faire partie de l'écosystème florissant" de la France sur le site de OpenAI (lien archivé ici).

En effectuant des recherches sur le site de l'Assemblée nationale, qui recense des projets de loi en cours de proposition ou débattus, nous n'avons pu retrouver, au 26 décembre, aucune proposition d'interdiction de ChatGPT dans le pays (lien archivé ici).

Une proposition de loi visant à identifier les images générées par l'IA publiées sur les réseaux sociaux a en revanche été déposée le 3 décembre 2024 (lien archivé ici).

OpenAI, comme les autres entreprises, doit respecter le droit français et européen, notamment en matière de protection des données personnelles et de droit d'auteur, sous peine d'être sanctionnée.

Aux Etats-Unis, elle avait déjà dû faire face à une série de procès intentés par des sociétés américaines pour violation présumée des droits d'auteur.

Mais une pure et simple interdiction pour ChatGPT ou OpenAI en France serait en l'état hautement improbable, selon plusieurs spécialistes interrogés par l'AFP.

Une telle interdiction improbable en l'état pour les experts

"Il peut y avoir des procédures d'investigation et des sanctions en cas d'infraction" de la part d'OpenAI, a expliqué à l'AFP le 23 décembre Maître Alexandre Lazarègue, avocat spécialisé en droit du numérique, "mais en aucun cas le président ne peut décider de mettre un terme aux activités commerciales d'une entreprise".

L'avocat pointe toutefois le manque de transparence de OpenAI concernant la collecte et l'exploitation des données des utilisateurs de ChatGPT, qui suscite des inquiétudes en matière de protection des données personnelles.

"Le droit est en construction sur le sujet", a ajouté le 24 décembre auprès de l'AFP Thomas Dautieu, directeur de l'accompagnement juridique à la Cnil, la Commission nationale de l'informatique et des libertés, chargée du contrôle du respect par ChatGPT du RGPD, le Règlement général de protection des données, un texte qui s'applique dans toute l'Union européenne (lien archivé ici).

"Comment appliquer le RGPD aux IA, notamment pour la constitution des bases de données ? Ce n'est pas évident, on est encore en train d'y travailler", poursuit Thomas Dautieu, qui indique que la Cnil a reçu moins d'une dizaine de plaintes concernant des manquements de ChatGPT au respect de la protection des données personnelles.

En 2023, la commission a publié sur son site un plan d'action pour un "déploiement de systèmes d'IA respectueux de la vie privée des individus" (lien archivé ici).

Sur le territoire de l'Union européenne (UE), c'est l'équivalent irlandais de la Cnil qui est chargé d'instruire les plaintes concernant ChatGPT, car le premier bureau de l'entreprise à ouvrir ses portes au sein de l'UE était à Dublin.

Les décisions de la Cnil irlandaise sont ensuite soumises à l'ensemble des organismes équivalents à la Cnil dans les pays de l'UE, réunis au sein du Comité européen de protection des données (CEPD). Les sanctions peuvent aller de l'avertissement à l'amende, jusqu'à une interdiction, indique Thomas Dautieu. "C'est possible dans les textes, mais on en est très loin, et ça n'a jusqu'ici jamais été décidé par le CEPD", poursuit le juriste.

"La mesure ne pourrait être prise qu'après un consensus européen", précise Thomas Dautieu. Selon lui, il ne pourrait par ailleurs alors s'agir que d'une "interdiction temporaire le temps que l'entreprise se conforme au RGPD. Et on n'est pas dans cette logique".

Il existe un "contre-exemple" : ChatGPT a été épinglé par l'équivalent italien de la Cnil pour non-respect de la protection des données, pour des faits antérieurs à l'arrivée de OpenAI en Irlande, qui remonte au mois de septembre 2023.

En mars 2023, l'autorité italienne de protection des données (GPDP) était donc pleinement compétente pour sanctionner l'entreprise. Elle avait alors brièvement interdit l'utilisation de ChatGPT en Italie en raison de violations présumées du respect de la vie privée (lien archivé ici).

Le 20 décembre dernier, l'Italie a infligé une amende de 15 millions d'euros à OpenAI pour avoir frauduleusement fait utiliser des données personnelles par ChatGPT, toujours pour des faits antérieurs à septembre 2023 (lien archivé ici).

Pour résumer, ChatGPT pourrait faire l'objet de sanctions en cas de non-respect du RGPD de la part du CEPD à l'échelle de l'Union européenne ou de la Cnil à l'échelle française pour des faits antérieurs au mois de septembre 2023, mais il est très improbable qu'une interdiction soit prononcée.

A ce stade, si des plaintes ont été déposées, rien ne justifierait une interdiction de ChatGPT en France ou à l'échelle européenne, selon les experts interrogés par l'AFP.

Certains systèmes d'IA bientôt interdits dans l'UE, mais pas ChatGPT

Par ailleurs, l'intelligence artificielle fait l'objet d'un premier règlement européen, adopté par l'UE en 2024. La loi européenne sur l'intelligence artificielle, appelée en anglais AI Act, entrera progressivement en vigueur dans les pays membres de l'UE à partir de février 2025, jusqu'au mois d'août 2027 (lien archivé ici). Le calendrier précis de l'application de la loi peut être consulté sur un site dédié ici (lien archivé ici).

Cette première loi globale visant à réglementer l'utilisation de l'IA dans les pays de l'UE affiche pour objectif de "garantir de meilleures conditions de développement et d'utilisation de cette technologie innovante" (lien archivé ici).

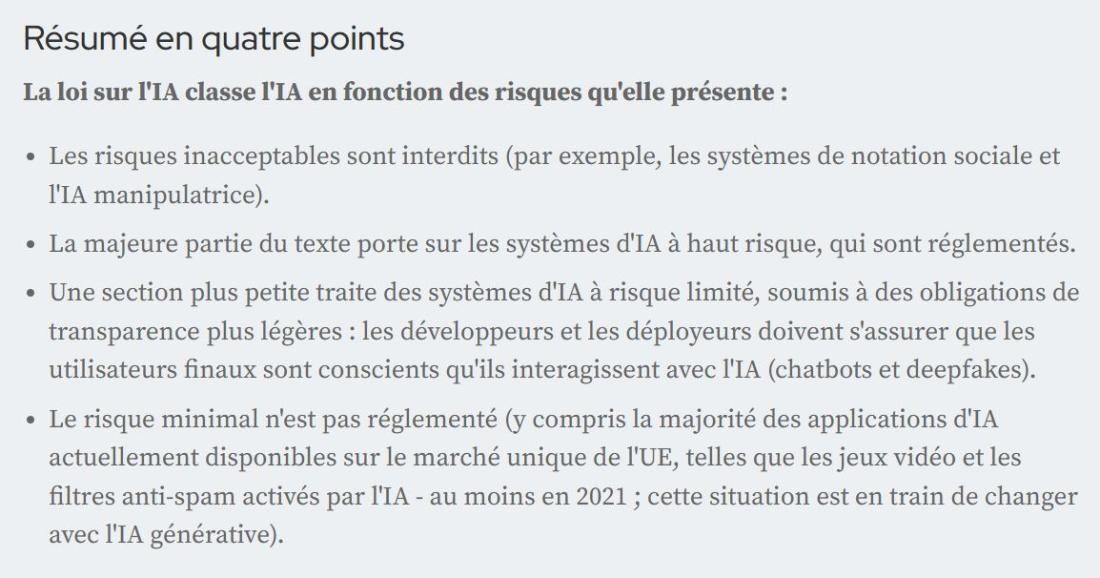

Le texte classe les systèmes d'IA en fonction des risques qu'ils présentent pour les utilisateurs, avec une réglementation qui varie en fonction du niveau de risque estimé (lien archivé ici).

Certains systèmes d'IA comportant des "risques inacceptables", considérés comme une menace pour les personnes, feront bien l'objet d'une interdiction dès le 2 février 2025. Mais ChatGPT n'en fait pas partie.

Les systèmes aux "risques inacceptables" sont ceux qui comprennent de "la manipulation cognitivo-comportementale de personnes ou de groupes vulnérables spécifiques : par exemple, des jouets activés par la voix qui encouragent les comportements dangereux chez les enfants", qui créent un "score social" ayant pour vocation de "classer les personnes en fonction de leur comportement, de leur statut socio-économique, de leurs caractéristiques personnelles", ou encore des systèmes d'identification biométrique en temps réel et à distance, comme la reconnaissance faciale.

"L'IA générative, comme ChatGPT, ne sera pas classée à haut risque, mais devra se conformer aux exigences de transparence et à la législation de l’UE sur le droit d'auteur", peut-on lire sur le site du Parlement européen (lien archivé ici).

Ainsi, ChatGPT ne sera pas interdit selon la nouvelle réglementation adoptée par l'UE. Il sera cependant soumis à de nouvelles obligations, comme celle d'indiquer que le contenu a été généré par IA, de concevoir le modèle pour l'empêcher de générer du contenu illégal ou encore de publier des résumés des données protégées par le droit d'auteur utilisées pour la formation.

En cas de non-respect de ces règles imposées par l'UE, les entreprises s'exposeront à des amendes pouvant aller jusqu'à 35 millions d'euros, ou 7% du chiffre d'affaires mondial (lien archivé ici).

L'entreprise OpenAI assure à l'AFP s'engager à se conformer à cette nouvelle réglementation. Elle affirme par ailleurs travailler en étroite collaboration avec le Bureau européen de l'IA pour contribuer à l'élaboration d'un code de bonnes pratiques, à mesure que la loi est mise en œuvre.

Emmanuel Macron, soutien de l'IA

Si l'AFP n'a pas été en mesure de retrouver de mention d'Emmanuel Macron à une volonté d'interdire ChatGPT en France, le président a au contraire affiché à plusieurs reprises sa volonté de faire de la France un leader en matière d'IA.

Dès 2018, le gouvernement avait lancé une stratégie nationale pour l'intelligence artificielle (lien archivé ici), investissant près de 2,5 milliards d'euros du plan France 2030 dans l'IA, peut-on lire sur le site du ministère de l'Economie (lien archivé ici).

"La France veut investir pour être à la pointe de l'IA, ce serait incohérent que le président prenne des mesures contre ChatGPT", estime de son côté Maître Alexandre Lazarègue.

Paris accueillera par ailleurs le prochain Sommet pour l'action sur l'intelligence artificielle, qui se tiendra les 10 et 11 février 2025 (lien archivé ici).

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.