Personne ne peut "défendre ou promouvoir" les "contenus haineux" sur Facebook ? Contestable

- Cet article date de plus de six ans.

- Publié le 28 novembre 2019 à 18:40

- Mis à jour le 10 octobre 2025 à 08:53

- Lecture : 4 min

- Par : Guillaume DAUDIN, Julie JAMMOT, Clara LALANNE, Taimaz SZIRNIKS, AFP France

"Si vous les payez, Facebook diffusera toutes les publicités +politiques+ que vous voulez, même si elles contiennent des mensonges", a déclaré jeudi 21 novembre le comédien et humoriste Sacha Baron Cohen lors d'une conférence organisée à New York par l'association de lutte contre l'antisémitisme ADL (Anti-Defamation League) où un prix lui était remis.

"Partant de cette logique tordue, si Facebook avait existé dans les années 1930, il aurait laissé Hitler poster des pubs de 30 secondes sur sa +solution+ au +problème juif+", a lancé l'acteur britannique, connu pour son goût de la provocation et pour avoir incarné des personnages comme Ali G, Borat ou Brüno.

Facebook a annoncé, en septembre, qu'il ne filtrerait pas les publicités politiques, estimant que, de manière générale, il était intéressant pour les internautes de les voir, suscitant un feu nourri de critiques, là où Twitter ou Google ont annoncé des politiques différentes.

Mais lors d'une audition mouvementée devant le Congrès américain, M. Zuckerberg avait prévenu que le réseau supprimerait toute publication "appelant à la violence ou qui pourrait engendrer des violences physiques imminentes", y compris des publications politiques.

"Sacha Baron Cohen a déformé la politique de Facebook", a répondu auprès de l'AFP un porte-parole du réseau social. "Les discours haineux sont bannis de notre plateforme. (...) Personne, y compris les personnalités politiques, ne peut défendre ou promouvoir la haine, la violence, ou les meurtres de masse sur Facebook".

Le géant américain a reproduit cette réponse à plusieurs reprises, mot pour mot, sur son compte Twitter francophone, en réponse aux médias tweetant les propos de Sacha Baron Cohen.

Capture d'écran des réponses sur Twitter du compte de Facebook France (@facebookFR), prise le 27 novembre 2019

Que peut-on trouver sur Facebook ?

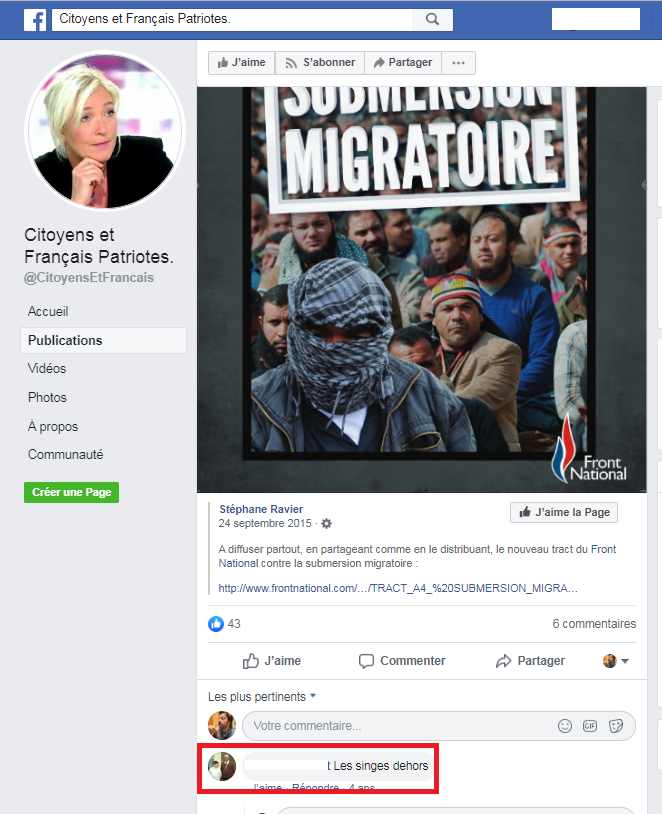

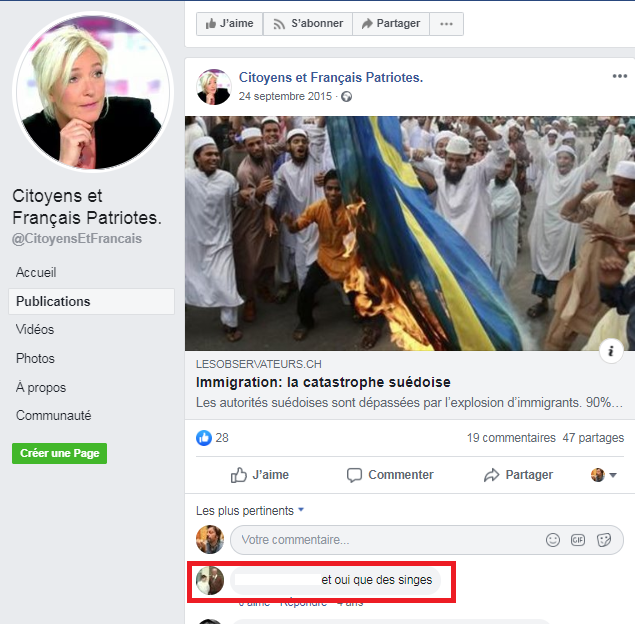

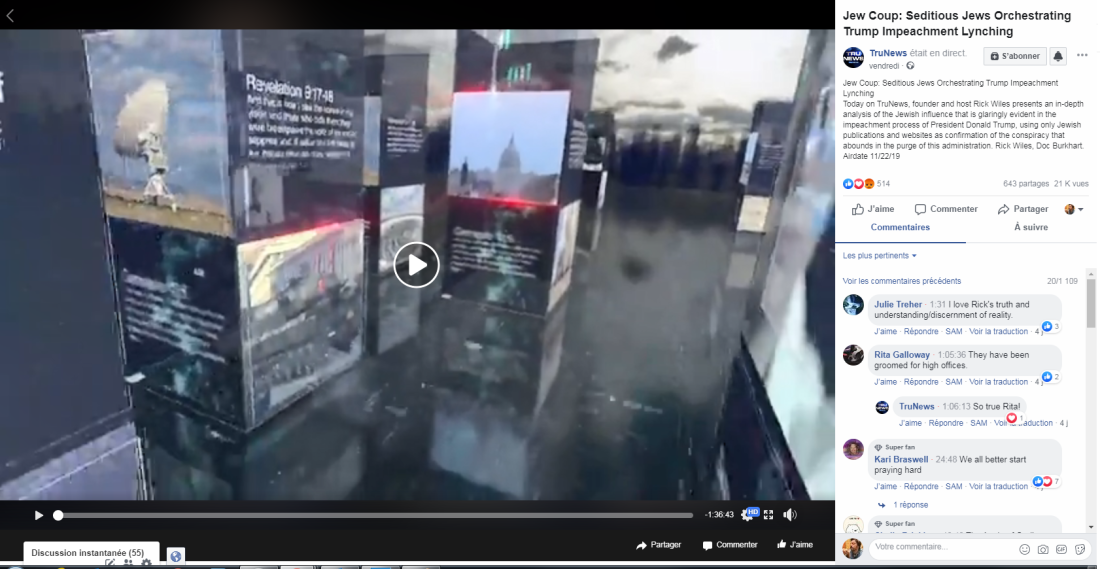

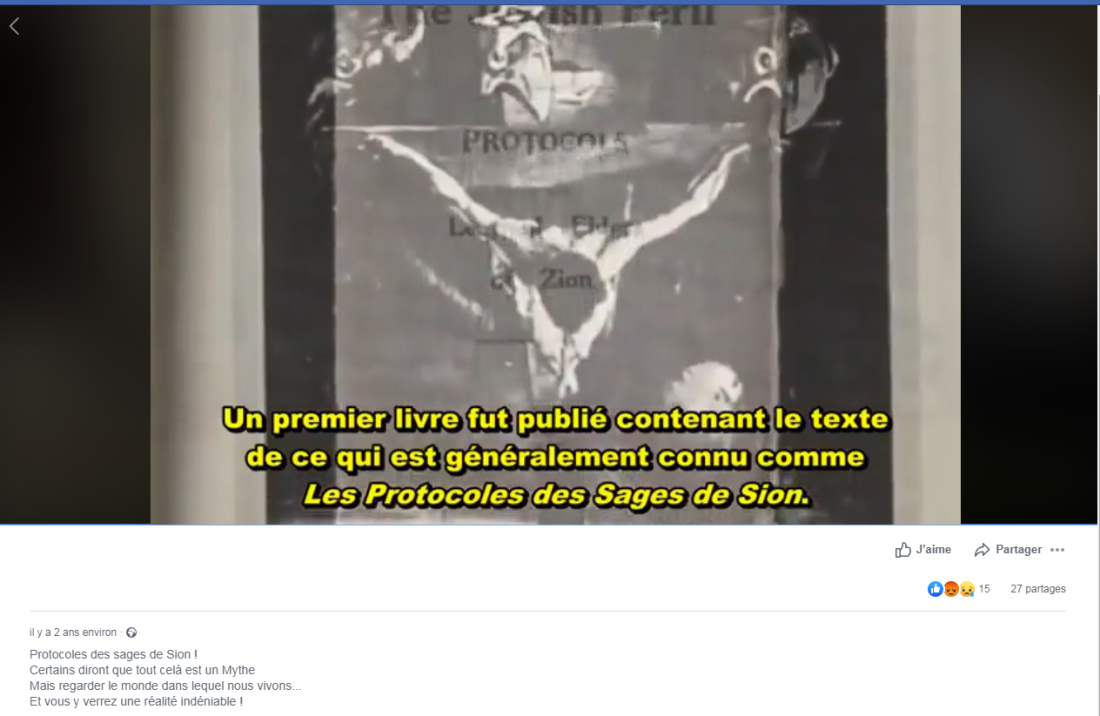

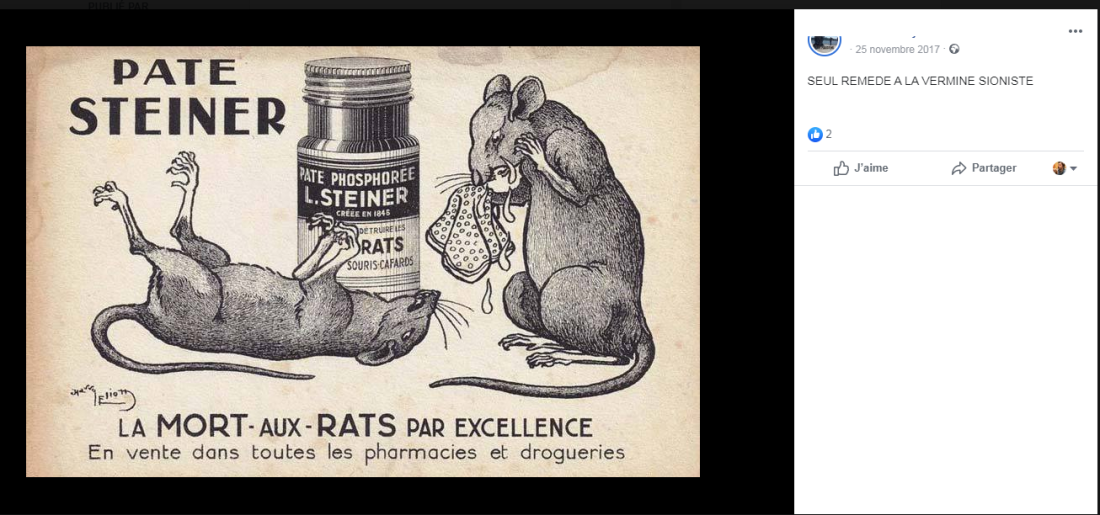

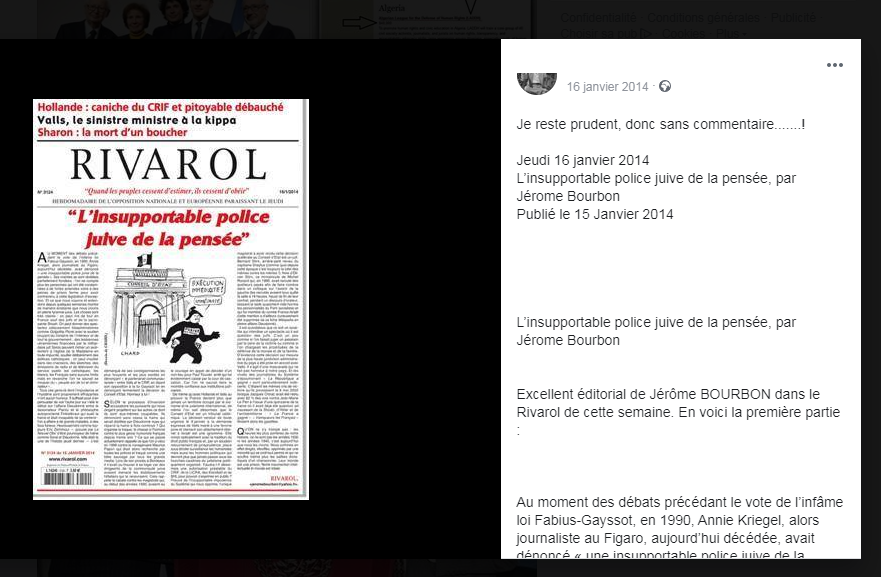

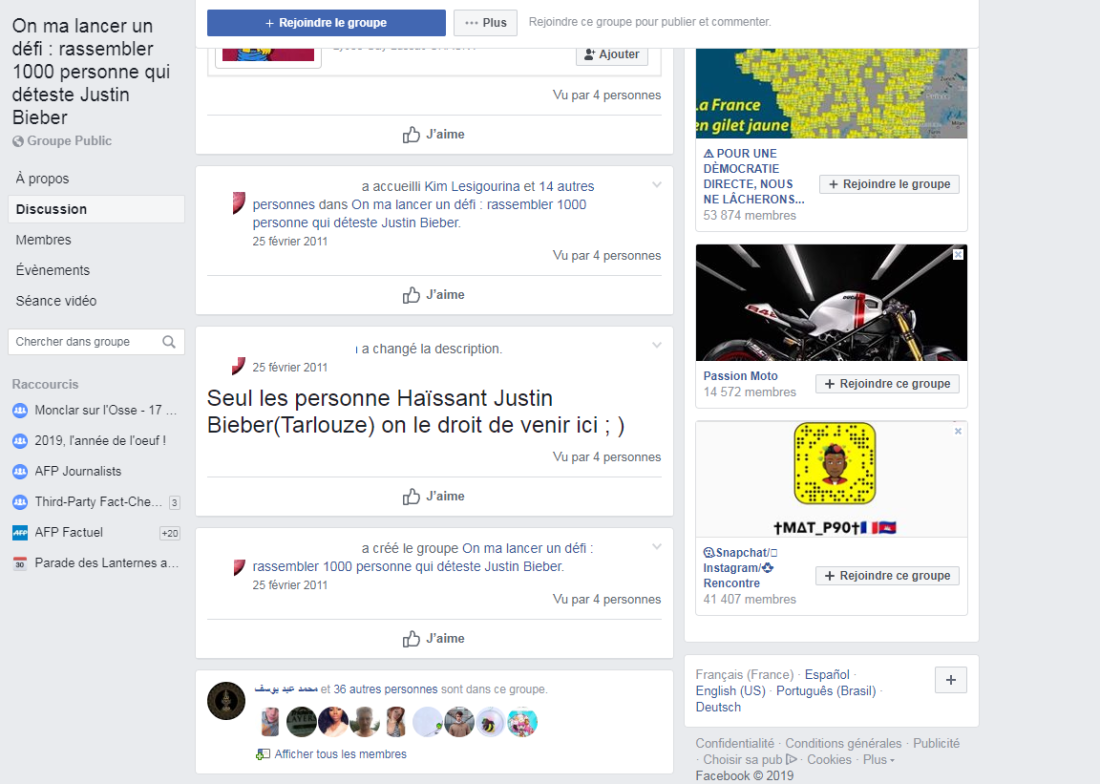

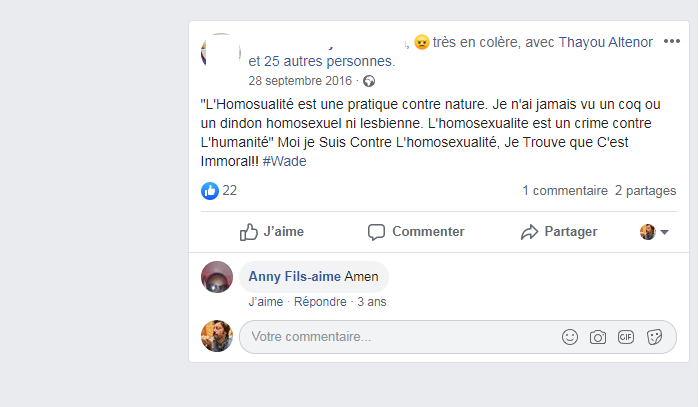

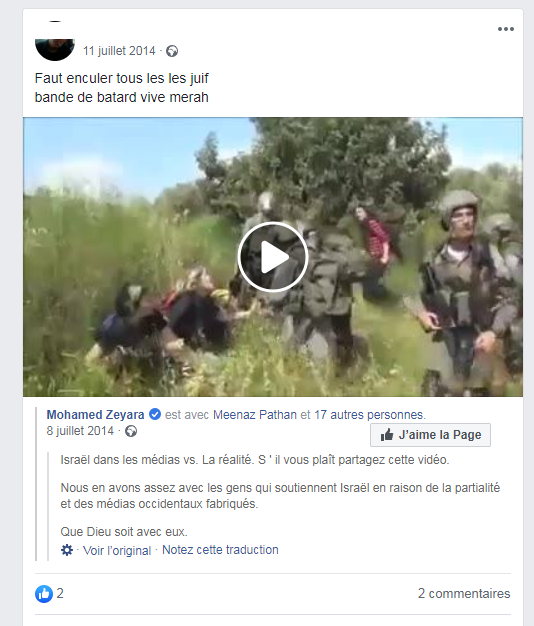

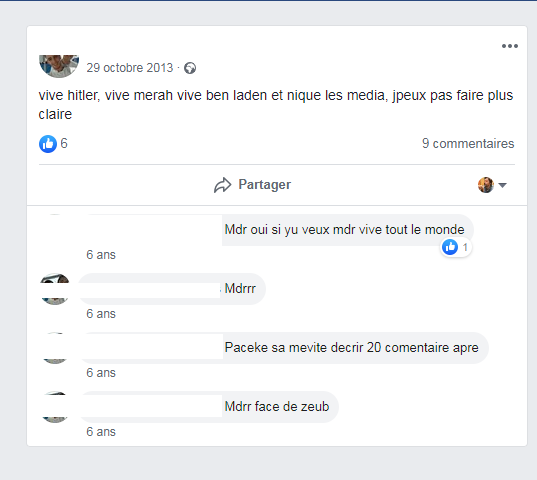

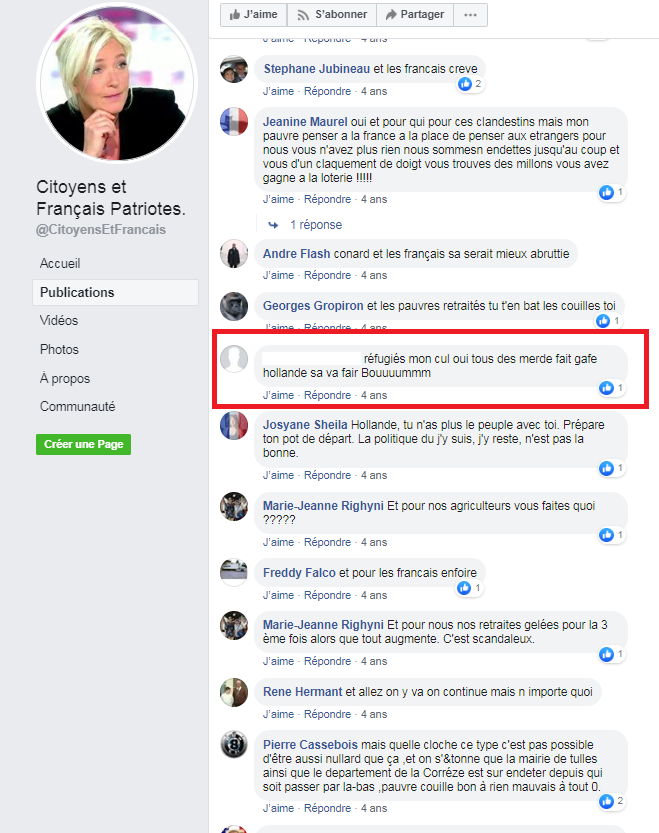

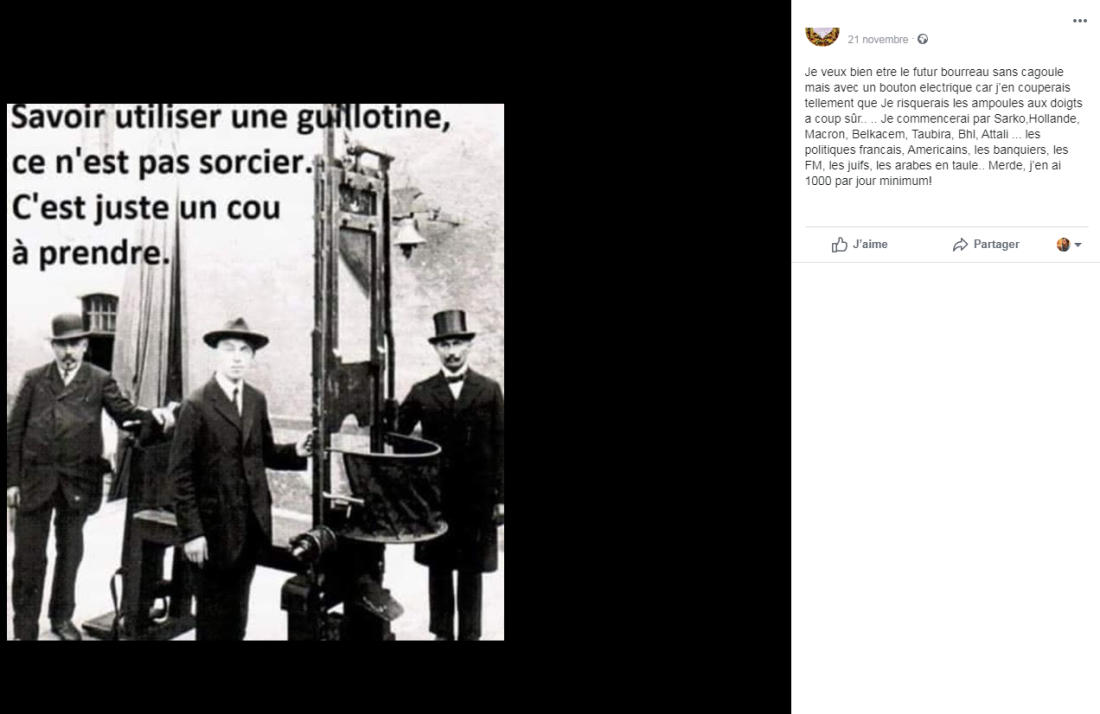

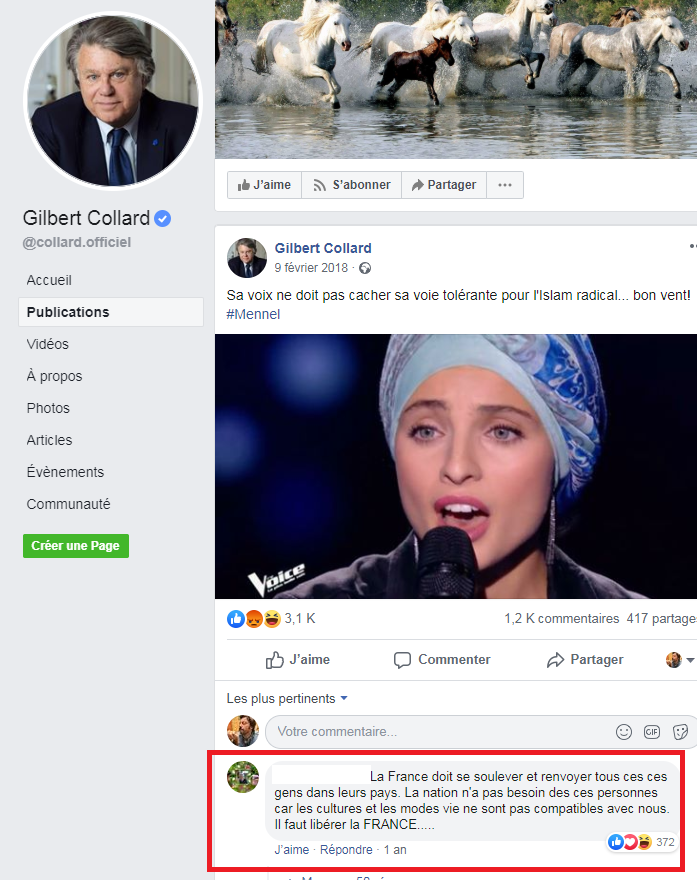

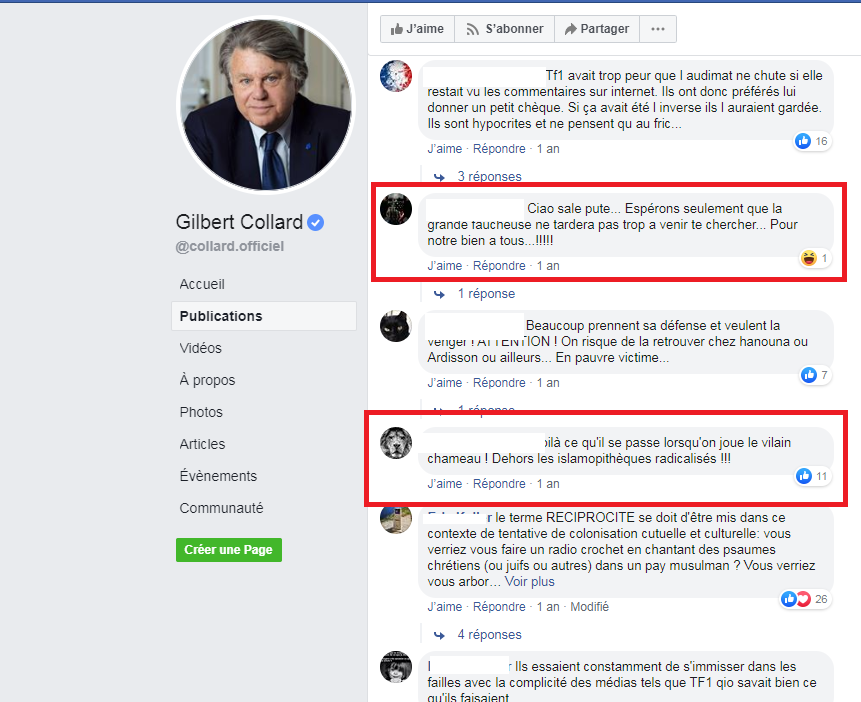

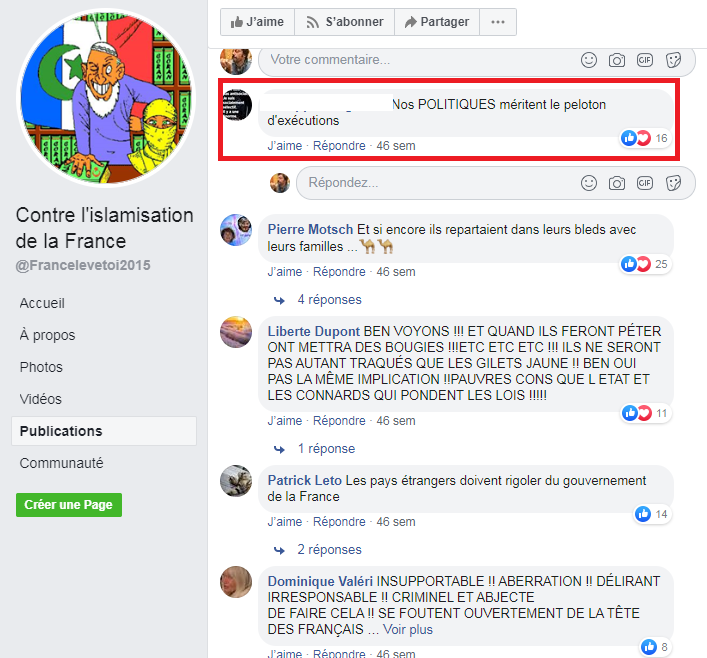

Une recherche rapide sur Facebook menée par l'AFP mercredi 27 novembre seulement en langue française montre pourtant qu'on retrouve aisément des contenus correspondant à la "promotion de la haine, de la violence ou des meurtres de masse".

Certains de ces contenus, partagés ou commentés, sont présents parfois depuis 2011, sans avoir été supprimés par le réseau social.

Racisme

[warning]

Antisémitisme

Homophobie

Apologie des crimes de masse

Appels à la violence

Le compte Twitter DebunkerHED a lui aussi tweeté de telles captures d'écran.

Quelles sont les mesures prises par Facebook ?

L'AFP a contacté Facebook pour les interroger sur leur politique en la matière, sans leur soumettre spécifiquement les publications appelant à la haine détectées et publiées un peu plus tôt dans cet article. Un porte-parole de Facebook a insisté sur le fait que leurs règles n'autorisent pas ce type de propos.

Le réseau dominant a traversé plusieurs scandales d'utilisation néfaste de ses plateformes, des contenus dangereux aux campagnes de désinformation menées pendant des campagnes électorales, qui nuisent à la démocratie.

Facebook a lancé en décembre 2016 le third party fact-checking program, notamment avec l'AFP à partir de début 2018 (voir plus bas), qui vise à utiliser les vérifications de médias spécialistes en fact-checking afin de limiter la désinformation sur la plateforme. Cette désinformation est parfois utilisée pour alimenter des discours de haine.

Plus récemment, le réseau social a multiplié les mesures pour nettoyer les contenus "haineux et extrémistes" et a accru en particulier ses efforts pour ajouter les mouvements ou individus prêchant le suprémacisme blanc à sa liste "d'organisations terroristes".

Le géant des technologies a affirmé avoir supprimé 5,4 milliards de faux comptes d'utilisateurs depuis le début de l'année, contre 2,1 milliards l'année dernière à la même période.

Le réseau fondé par Mark Zuckerberg a été vivement critiqué pour avoir mis 17 minutes avant de stopper la vidéo retransmise en direct d'un suprémaciste blanc, qui s'est filmé pendant qu'il attaquait une mosquée le 15 mars 2019 à Christchurch, en Nouvelle-Zélande. Il a tué 51 fidèles musulmans.

"Nos efforts sont en train de payer", assure d'emblée Mark Zuckerberg, lors d'une conférence de presse mercredi 13 novembre, à l'occasion de la publication d'un rapport bi-annuel de Facebook sur la transparence, se targuant dans le même temps d'avoir supprimé 5,4 milliards de faux comptes d'utilisateurs depuis le début de l'année.

Mais il reconnaît que les technologies d'intelligence artificielle (IA) ont plus de mal à repérer les discours haineux que les vidéos comportant de la nudité, à cause des "nombreuses nuances linguistiques".

Dans son rapport, Facebook reconnaît que ses techniques de détection de contenus violant ses standards ne sont "pas toujours parfaites".

C'est tout le problème du contexte: une vidéo montrant une attaque raciste peut être partagée à des fins de condamnation... ou de glorification.

Difficile par exemple de savoir dans quel but des utilisateurs ont essayé, et essaient encore, de republier la vidéo de la tuerie de Christchurch. Mais les algorithmes de Facebook ont su bloquer en amont 95% de leurs tentatives, d'après les chiffres divulgués. En tout, depuis l'attaque le 15 mars dernier, 4,5 millions d'extraits de cette vidéo ont été détectés par l'IA, de même source.

En tout, Facebook annonce compter 35 000 personnes qui travaillent, en interne et chez des entreprises partenaires, à la sécurité et à la modération de contenus sur ses plateformes, dont plus de 15 000 sur cette seule activité de modération.

"La probabilité que des utilisateurs voient des contenus interdits par notre règlement (...) est très faible. Quand nous faisons des tests il arrive que nous ne trouvions rien du tout", constate Guy Rosen, vice-président en charge de l'intégrité du réseau.

En juin, le réseau social américain a promis de fournir directement à la justice française des informations pour identifier les internautes diffusant des contenus haineux, comme l'expliquait cette dépêche AFP.

En septembre, Facebook, Google et Twitter ont annoncé la création d'une nouvelle structure indépendante de lutte contre les contenus extrémistes sur Internet, comme l'expliquait cette autre dépêche AFP.

Celle-ci prendra la suite d'un consortium, le Global Internet Forum to Counter Terrorism (GIFCT), créé en 2017 par Facebook, Microsoft, Twitter et Google (via YouTube). Le géant de Seattle Amazon ainsi que les plateformes LinkedIn (appartenant à Microsoft) et WhatsApp (Facebook) ont rejoint la structure remodelée.

EDIT: 10/10/25 Cet article a été mis à jour afin d'en retirer un photomontage qui circulait sur les réseaux sociaux, car il utilisait l'image d'une personne de manière dénigrante

Copyright AFP 2017-2026. Toute réutilisation commerciale du contenu est sujet à un abonnement. Cliquez ici pour en savoir plus.